LLM能否自我评估安全性?RAIN:一种无需微调即可改善AI对齐和安全防御新方法

文章概要:

1. 大型语言模型(LLM),如GPT-3,通过自我评估和改进方法(RAIN)能够满足人类需求,无需额外数据和微调。

2. RAIN方法具备广泛适用性,适用于多种语言生成任务,无需额外模型或数据存储,且无需依赖标记数据或训练。

3. RAIN通过自我评估提高LLM的性能,降低对敌对攻击的成功率,为AI生成更协调和安全的响应。

研究表明,大型预训练语言模型(LLM),如GPT-3,具有出色的能力,可以理解和回答人类提出的问题,协助编码工作等。然而,它们常常生成与人类偏好不同的结果。

过去,研究人员试图通过收集有关人类偏好的信息来解决这个问题,然后通过使用强化学习或指令调整来调整先前训练的模型,从而需要一个微调阶段。调整冻结的LLM(尚未接受额外训练且不需要额外数据)更具吸引力。

图源备注:图片由AI生成,图片授权服务商Midjourney

最近,一组研究人员发现,未对齐的LLM可以通过包括自我评估和回溯机制的自我改进过程直接生成与人类偏好匹配的回复。出于AI安全性的考虑,他们引入了可回滚自动回归推理(RAIN),这是一种独特的推理技术,使预训练的LLM能够评估其自动生成的文本,并使用评估结果来指导向后倒带和向前生成。

RAIN以其无需进一步数据进行模型对齐的能力而著称。它消除了对参数更新、梯度计算或训练的需求。模型通过固定模板提示在自我评估阶段获取有关应对齐哪些人类偏好的指导,从而省去了反复调整初始查询的需求。

实验结果由GPT-4模型和人工评估员评估,体现了了RAIN的成功。例如,使用HH数据集,RAIN在保持LLaMA30B的有用性率不变的同时,与普通推理相比将其无害性率从82%提高到97%。

该团队表示,当 Vicuna33B 成为显着敌对攻击 (LLM-ATTACKS) 的目标时,RAIN 甚至通过将攻击成功率从94% 降低到19% 建立了新的防御基准。

RAIN在对齐大型语言模型(LLM)方面具有许多优势:

- 通用性:RAIN方法具有广泛的适用性,适用于各种语言生成任务。它与自回归推理范式完美契合,这是许多LLM的常规范式。这意味着RAIN高度可定制且用户友好,可以快速集成到大多数现有LLM中。

- 与冻结权重的对齐:RAIN不需要维护额外的模型或存储梯度数据和计算网络,与一些其他对齐策略(如RLHF)相比,其产生的最低内存开销与简单自回归推理相当。由于其简单的实现和高效的内存设计,RAIN是对齐冻结权重的LLM的现实选择,消除了资源密集型的微调过程。

- 无需学习:RAIN不依赖于任何类型的标记或未标记数据,也不依赖于人类注释。它以无需学习的方式运作,不需要大量信息或培训,因此在各种任务中显著提高了对齐性能,并使LLM更加抵抗敌对提示攻击。在评估一个着名的敌对攻击方法时,RAIN显著降低了攻击成功率,展示了其作为防御措施的潜力。

这项研究引入了RAIN作为一种调整LLM以满足人类偏好的技术,无需额外信息或繁琐的微调。这是通过允许LLM评估和改进其自身输出来实现的,最终产生更协调和安全的AI生成响应。

论文网址:https://arxiv.org/abs/2309.07124

马斯克要求特斯拉北美交车时必须带客户体验FSD自动驾驶

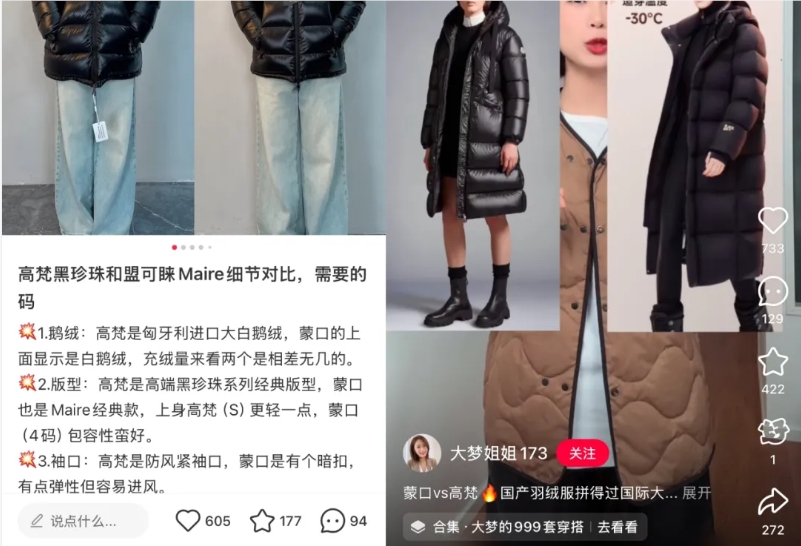

特斯拉CEO马斯克最近发布全员信,为特斯拉北美业务设立了新规定:员工在向北美客户交付汽车之前,必须陪同客户开启FSD功能进行一次短途试驾。马斯克强调,这是一项硬性要求,即使这可能会影响到交车速度。马斯克表示,尽管知道此举可能会拖慢交付速度,但他坚信这一步骤是必要的,因为“几乎没有人真正意识到FSD实际做得有多好”。他要求员工在完成FSD功能演示后,必须对车辆进行全面检查,确保车辆处于最佳状态。站长网2024-03-26 10:39:580000网络播放量将制定统一标准:时长超3秒就算有效播放行为

快科技1月19日消息,国家广电总局日前发布了关于对《网络视听收视指标及计算方法》的公示通知。(源文点此查看)通知中,对用户有效性”、有效播放行为”、统计周期判定”、用户数统计要求”、播放行为时长和次数”等,均做出了明确的技术要求和统计规范。而网友最为关注的网络播放量”,也将迎来统一标准。通知指出,对于有效播放行为判定要求:1、播放速率小于3倍速的播放行为;2、收视时长大于3s的播放行为。站长网2024-01-20 12:12:110000从居家到工作,CES 2024上演 AI硬件大秀

新年伊始,科技圈迎来了首场世界级盛会。1月9日到12日,国际消费类电子产品展览会(CES)在美国拉斯维加斯举办。从1967年举办至今,CES被视作整个消费电子领域的风向标,云集了当前最优秀的消费类电子厂商和IT核心厂商。今年的CES也是众星云集,参展的企业超过4000家,包括英伟达、英特尔、AMD、三星、索尼等,中国企业如TCL、海信、极米、科沃斯、Anker等也纷纷奔赴这场盛宴。站长网2024-01-15 17:04:180000百果园抖音团购年销2亿解密

水果零售常年是一个难做的行业,中间链路多、运输消耗大、销售成本高,从路边摊到专业门店,线上线下都是竞争对手。在这个行业中,抖音本地生活年销破亿是件很难的事。但百果园做到了:8000万会员规模和700万月活跃、2000万以上年活跃;6000的全国门店账号;100万的短视频数量造就了抖音团购年销2.4亿,成为“抖音本地生活水果类目第一”。0001魅族 20 INFINITY 无界版今日开售 起售价6299元

今日10点,魅族20INFINITY无界版将正式开售,可享3年质保至高24期免息,起售价6299元,16GB1TB售价8499元。据介绍,魅族20无界版,双面配备魅族泰坦玻璃,搭载特别定制6.79英寸2K21:9无界臻彩屏和Unibody无界蓝宝石镜片。整机中框采用Hybrid超轻量不锈钢,重量减轻30%,散热效率提升40%,抗摔表现提升4倍。站长网2023-06-12 17:12:560000