OpenAI招募专家加入“红队”网络,加强AI模型安全性

文章概要:

1. OpenAI宣布了一项公开招募专家的计划,旨在邀请跨领域的专家加入OpenAI“红队”网络,以提高其人工智能模型的安全性。

2. “红队”网络是OpenAI的迭代开发过程的一部分,包括内部和外部对抗性测试,旨在加深与外部专家的合作,确保模型安全。

3. 网络成员将根据其专业领域在整个模型和产品开发生命周期中协助进行风险评估,而且他们不会被限制发表研究或寻求其他机会,但需要遵守保密协议。

OpenAI宣布了一项旨在加强其人工智能模型安全性的重要计划,即启动了“红队”网络。这一计划的目标是邀请来自各个领域的专家,加入他们的“红队”网络,共同评估和对抗其AI模型的潜在风险。

“红队”网络是OpenAI迭代开发流程的一部分,它包括内部和外部的对抗性测试,以确保模型在各种情况下都能够表现出安全性和稳定性。通过这一计划的正式发布,OpenAI旨在与外部专家建立更为密切的合作关系,以提高其AI模型的整体安全性和可靠性。

“红队”网络的成员将根据其专业领域在整个模型和产品开发生命周期中协助进行风险评估。这意味着他们将能够提供多样化和持续的专业意见,有助于将红队成为一个不断迭代的过程。值得一提的是,OpenAI的行动号召向全球各地的专家敞开大门,无论他们之前是否拥有人工智能系统或语言模型的经验。

参与红队项目的网络成员将获得报酬,同时还将有机会与其他专家就一般红队实践和经验教训进行互动。值得注意的是,这些专家不会受到限制,可以自由发表研究或追求其他职业机会,但他们必须遵守保密协议(NDAs)。

OpenAI的“红队”网络计划无疑是为了加强其AI模型的安全性,并通过吸引来自不同领域的专家,使其能够更全面地评估和改进其技术。这一举措有望为人工智能的未来发展提供更坚实的基础,确保其在各个领域的应用都能够更加可靠和安全。

全球AI人才报告曝光:清华第三,北大第六!硅谷40万人大裁员,码农地狱级面试12场

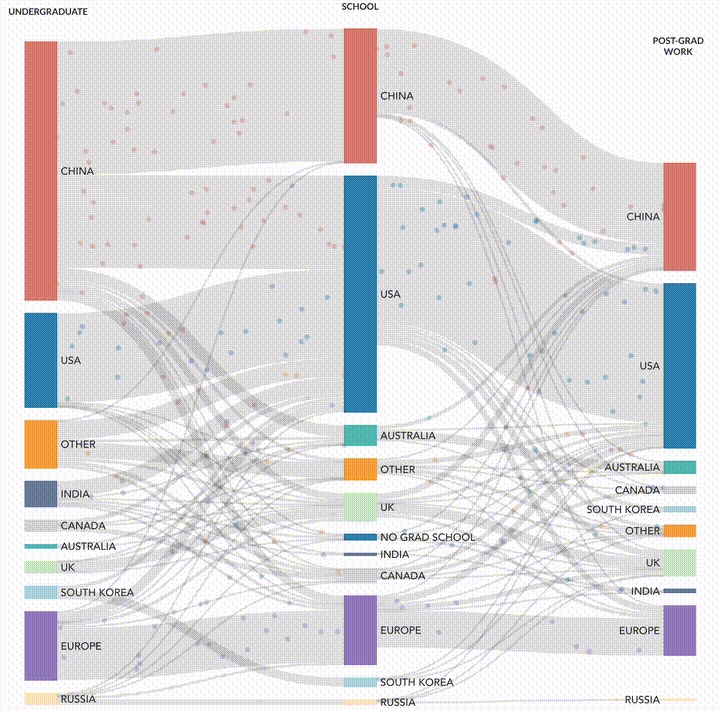

【新智元导读】刚刚发布的AI人才报告显示,全世界的顶尖AI人才中,几乎每两人中就有一人是中国培养出的人才!开卷后,美国码农们也都被迫开启了地狱模式,为一个offer面试12场。就在刚刚,全球AI人才报告发布。全世界的顶尖AI人才中,由中国培养出的人才已经占到了近1/2!有趣的是,当这些人卷到美国后,当地程序员的日子,似乎是越来越难了。站长网2024-03-11 09:31:360000一个行业的AI样板:教培的不同环节怎么被改写

三天内,使用AI的销售人员蓄客总数42个,70%以上(24个)是新引流客户。使用AI智能问答后,转人工会话量减少了40%,99%的对话都能在10秒内得到回复。应用AI批改作业后,老师们批改到凌晨两点也只能完成24%的作业,晚上10点前就能100%完全反馈,并且无论普通作业、作文还是英语作文,批改效率都提升了一倍。……0000告别免费时代,闲鱼着急赚钱?

“最多的一年,我在闲鱼上出掉了上百件闲置物品”,作为闲鱼的资深用户,李丽一度很满意闲鱼的交易场景。她认为,在这里卖家通过闲置物品变现得到了回血,而买家则用划算的价格得到了便宜。高频、天然、免费的交易场景,让闲鱼吸引了千千万万李丽这样的卖家,他们为闲鱼共同构筑用户生态。根据数据平台QuestMobile最新报告显示,2024年4月,闲鱼月活用户已达到了1.62亿。站长网2024-08-07 14:22:310000LVMH创始人身价跌至全球第三 马斯克再次成世界首富

快科技10月18日消息,据报道,随着奢侈品股票近日遭遇抛售,LV老板伯纳德?阿尔诺失去了全球第二富豪的头衔,目前他拥有的财富已经低于亚马逊创始人杰夫?贝佐斯。法国奢侈品巨头LVMH创始人兼CEO贝尔纳阿尔诺,失去了世界第二大富豪的宝座,回到了富豪排行榜第三。当地时间17日周二,根据彭博亿万富翁指数,阿尔诺目前净资产为1550亿美元,低于亚马逊创始人贝佐斯的1560亿美元。0000字节跳动捐赠500万元 支援琼粤等台风受灾地区灾后重建

据抖音集团官方消息,9月11日,北京字节跳动公益基金会宣布捐赠500万元人民币,联合中国教育发展基金会、中国乡村发展基金会等公益机构,支持海南、广东等受灾严重的地区开展道路清障、校园修缮等灾后恢复重建工作。字节跳动公益平台同步启动应急响应机制,上线相关救灾公益项目,开展专题筹款,增加捐赠入口,支援应急救灾工作。站长网2024-09-12 03:52:560000