LongLoRA:提升LLM上下文能力的创新微调方法

要点:

1. LongLoRA是一种创新的微调方法,可以显著增强大语言模型的上下文处理能力,而无需消耗大量算力资源。

2. LongLoRA采用了两大步骤的高效微调方法,包括使用转变短注意力(S2-Attn)和有效扩大上下文的技巧,可以在不同任务上取得出色的结果。

3. LongLoRA展示了大型语言模型在处理更多信息时能力的提升,尤其擅长处理长文本和长对话中的特定主题,为处理复杂任务提供了新的可能性。

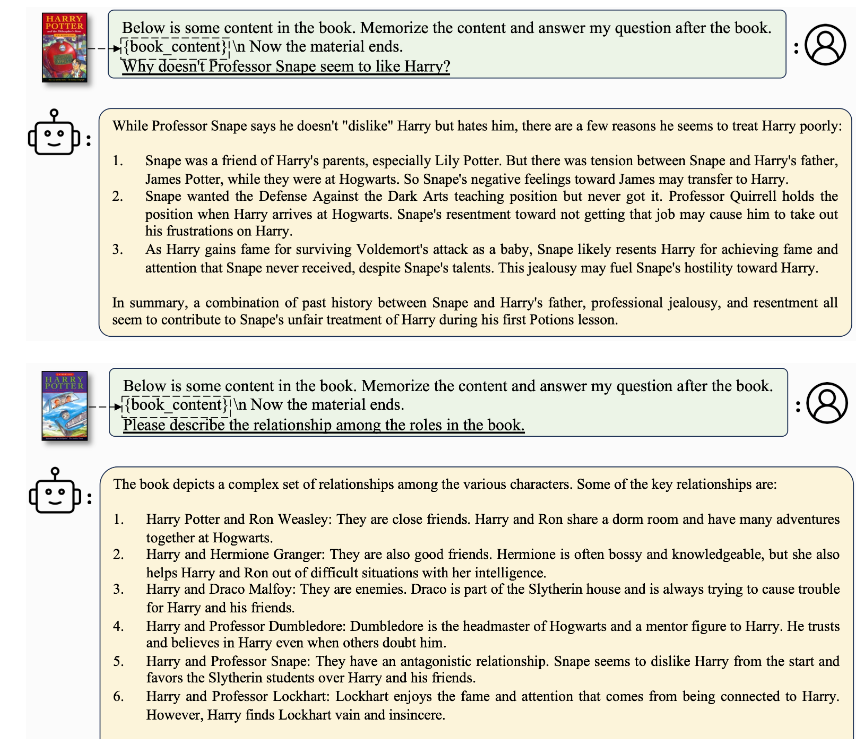

LongLoRA是一种全新的微调方法,旨在提高大语言模型(LLM)的上下文处理能力,而无需过多的算力资源。传统上,增加LLM的上下文处理能力需要大量的算力支持,但LongLoRA采用了创新的方法,使LLM能够处理更长的文本和更多的信息。这种方法的核心是采用了两大步骤的高效微调方法。首先,它使用了一种称为转变短注意力(S2-Attn)的新型注意力形式,该方法能够在训练过程中节省计算能力,同时保持了高效性。其次,LongLoRA重新挖掘了一种名为LoRA的方法,用于有效扩大训练信息的上下文。这个方法在与可训练的嵌入和规范化一起使用时非常有效。

开源地址:https://github.com/dvlab-research/LongLoRA

论文地址:https://arxiv.org/abs/2309.12307

LongLoRA的优势在于它能够在各种任务上取得出色的结果,并且可以与不同大小的LLM一起使用。它可以将用于训练的数据量从4k增加到100k,对于另一个模型,可以增加到32k,而所有这些都可以在一台强大的计算机上完成,与其他技术兼容性良好,不会改变原始模型设计架构。

研究还发现,随着上下文大小的增加,模型的性能更好,这证明了LongLoRA微调方法的有效性。使用更多信息进行训练可以带来更好的结果,例如,一个模型的困惑度性能从2.72降低到2.50,当上下文窗口从8192增加到32768时。此外,LongLoRA还在处理长对话中找到特定主题方面表现出色,与竞争对手相比,它更有效地适应开源数据。

LongLoRA提出了一种创新方法,使大型语言模型能够更轻松、更高效地处理大量信息,而无需消耗大量算力资源。它在处理长文本和复杂任务方面表现出色,为语言模型领域带来了新的可能性。

北美巨头一周内裁员3万,至暗时刻的转机在哪?

“有些人会看到“危”,有些人则会看到“机”。”作者|Lexie编辑|Lu首图来源:BusinessInsider本周一,Facebook母公司Meta表示,将再裁员1万人,成为首家宣布第二轮大规模裁员的大厂。四个月前Meta刚刚裁员1万1千人;本周三,招聘平台巨头Indeed表示,预计将裁员约2,200人,占员工总数的15%;站长网2023-04-17 18:34:310000大模型冰火两重天?GPT访问增速大跌,国内产品热度也下滑,但一天N个发布

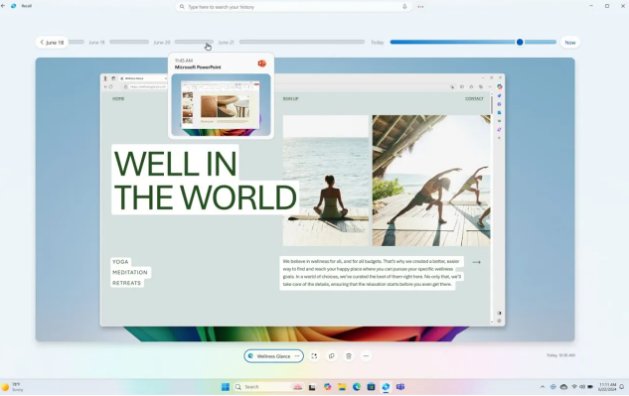

当下,大模型、AIGC到底是火还是不火了?让人摸不着头脑。一方面,有国内外的创业公司卖身、ChatGPT的访问量增速下滑、普通用户使用频次及关注度下滑;一方面,行业、大公司们动作频频,热火朝天。似乎,火了半年多的这个行业到了一个十字路口。傅盛朱啸虎激辩ChatGPT访问量增速下滑行业出现不同声音猎豹移动CEO傅盛和投资大佬朱啸虎在朋友圈激辩ChatGPT,引起了一阵讨论热潮。站长网2023-07-04 11:14:360005微软发布AI工具 Recall,帮助你找到那些找不到的文件

划重点:🔍Microsoft推出RecallAI,为你的电脑提供了“照片记忆”功能。🔍只有CopilotPC系列才能使用这一功能,目前限定在特定型号电脑上。🔍RecallAI允许用户使用语音查询文件、网站或电子邮件,并通过AI进行索引和搜索。站长网2024-05-22 01:00:490000一花“坠落”,万国货“生”

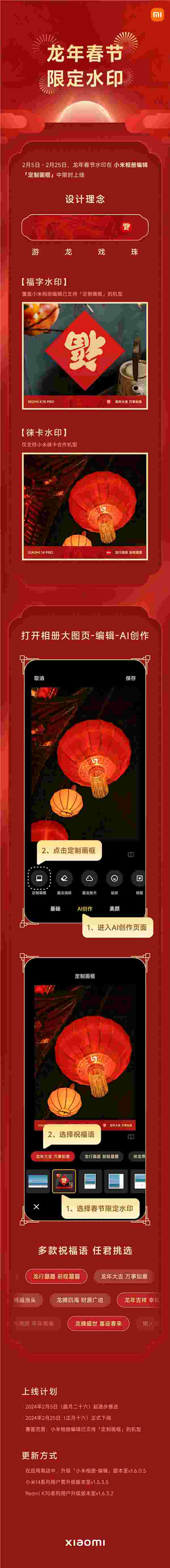

“整个国货圈乱成了一锅粥。”花西子可能也没有想到,李佳琦的直播失言,在连累自己成为“输家”的同时,也几乎以一己之力搅动了整个老牌国货圈。李佳琦落泪道歉后,处于风暴中心的花西子陷入众嘲,高“克”单价的新锐品牌未见发声,与之相对,以蜂花为代表的国货老品牌却敏锐蹭上热点,靠着玩梗与发疯文学,接下了花西子“跌倒”造就的泼天富贵。站长网2023-09-20 09:12:280000小米手机推出龙年春节限定水印 支持小米14、K70等机型

随着农历新年的临近,为了给用户带来更浓厚的节日氛围,小米手机特别推出了龙年春节限定水印功能。这一功能现已上线,支持多款热销机型,让用户在春节期间拍摄的照片更具特色。据了解,想要体验这一新功能,小米手机用户需要先在小米应用商店更新“小米相册-编辑”应用。具体版本要求如下:小米14系列用户需升级至v1.5.3.5版本,RedmiK70系列用户需升级至v1.6.3.2版本。站长网2024-02-05 14:15:290000