StreamingLLM:让AI模型无限期平稳运行的一种方法

要点:

1. Meta、麻省理工学院 (MIT) 和卡内基梅隆大学 (CMU) 的研究人员介绍了一项名为StreamingLLM的技术,旨在解决大型语言模型(LLMs)在长时间对话中性能下降的问题。

2. StreamingLLM利用“attention sinks”(关注点汇)的概念,通过在对话的不同阶段重新引入初始标记,使LLMs能够在无限长度的文本上保持高性能。

3. 研究人员还提出了使用单个特殊标记作为“attention sink”来稳定LLMs的关注机制,从而在长时间对话中保持高性能。

Meta、麻省理工学院 (MIT) 和卡内基梅隆大学 (CMU) 的研究人员最近发表的一篇新论文介绍了一项名为StreamingLLM的创新技术,旨在解决大型语言模型(LLMs)在长时间对话中性能下降的问题。

LLMs如OpenAI的ChatGPT和Meta的Llama2在当今的人工智能领域备受关注,但它们都面临一个共同的挑战,即在与用户的对话中始终提供高质量的响应,无论对话持续多长时间或交换的对话数量如何。这是因为LLMs在训练时是基于特定长度的数据块或序列进行预训练的,一旦用户输入的标记超过了这个长度,LLM的性能就会下降,这对企业希望在开放式对话中使用LLMs来帮助客户或员工是不可接受的。

图源备注:图片由AI生成,图片授权服务商Midjourney

StreamingLLM的解决方案是利用“attention sinks”概念,这些是在对话的不同阶段重新引入初始标记,以使LLMs能够在无限长度的文本上保持高性能。

研究人员发现,LLMs在对话或训练的早期会更加关注初始标记,因为它们对所有后续标记可见,而后续标记只对有限的后续标记可见。因此,通过在对话后期重新引入一些初始标记,用户可以有效地恢复LLM的性能。这就好比通过在对话后期使用与开始对话时相同的关键词,突然使LLMs在对话后期能够提供高质量的响应。

研究人员还提出了使用单个特殊标记作为“attention sink”的方法,通过在对话的不同阶段手动或自动重新引入此标记,可以持续保持LLMs的性能。这项技术使LLMs能够在无需频繁刷新缓存的情况下,不间断地为用户提供帮助。然而,研究人员也强调了这项技术的局限性,它并不扩展LLMs的上下文窗口,也不能确保LLM会记住对话的每个时刻的内容。

综合而言,StreamingLLM技术为LLMs在长时间对话中保持高性能提供了创新的解决方案,有望在许多领域,特别是需要持续不断地与用户交互的应用中得到广泛应用。

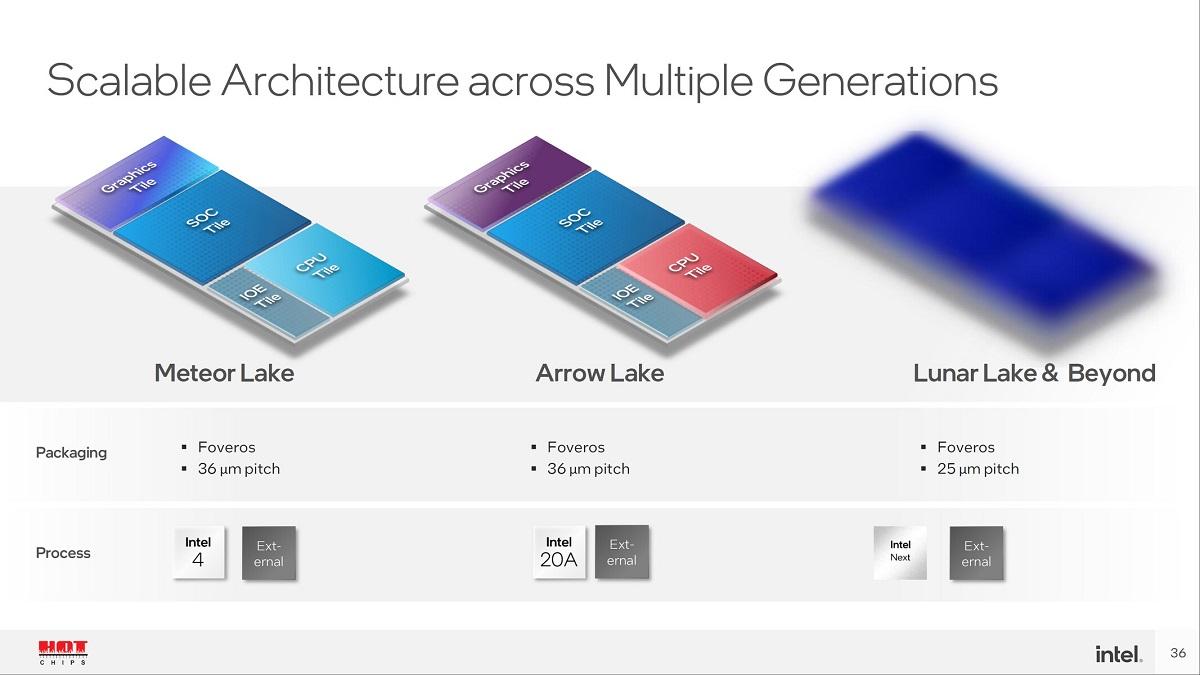

英特尔又又又取消了Meteor Lake-S,这次似乎是最终决定

站长网2023-05-25 04:31:010000拥抱鸿蒙生态,畅享5G体验,Hi畅享60 5G今日开售仅1399元

4月28日,首款6000毫安5G鸿蒙生态手机Hi畅享605G正式开售。其同时支持“鸿蒙生态”和“5G通信”的比较优秀组合,搭配6000毫安时超大电池和快充的续航能力,此前备受期待。128GB版本定价1399元,256GB版本定价1599元,这个价格可谓诚意满满。站长网2023-05-12 20:35:540000谷歌计划将在印度和日本推广人工智能搜索

站长之家(ChinaZ.com)8月31日消息:谷歌日前宣布,其人工智能驱动的搜索生成体验(SGE)计划正在进军印度和日本市场,以进一步拓展其在人工智能搜索领域的布局。该功能目前仍处于邀请加入的阶段。站长网2023-08-31 10:13:160000快手:严厉打击借欧洲杯赛事传播赌球、诈骗信息行为

近日,快手发布关于严厉打击借欧洲杯赛事传播赌球、诈骗信息的公告称,为倡导风清气正的社区氛围,保障用户财产安全,快手将针对欧洲杯赛事期间的各类赌博、诈骗行为开展专项治理,通过加固识别策略、丰富处置维度等方法加强对相关违法违规行为和不良内容的打击。快手称,平台严厉打击通过引流或欺骗性手段骗取其他用户信任,将用户引导至站外平台进行赌球或诈骗的行为,包括但不限于:站长网2024-06-21 16:44:050000自己拍的照片被视觉中国告侵权 视觉中国官方这样回应

今日,戴建峰在朋友圈发文表示,自己今天收到了@视觉中国打来的电话,称公众号侵权使用了他们173张照片,还被要求赔偿8万余元。而这些所谓的“侵权照片”竟然是他自己拍摄的作品。另外,戴建峰在微博也就此事发布了推文,要求视觉中国就此事进行说明。他表示,这些照片都是他自己陆续拍的,最早的是十年前,且不仅自己公司被起诉,朋友的公司也被起诉过。站长网2023-08-15 21:29:560000