研究显示:ChatGPT可能会被诱骗生成恶意代码

划重点:

1. 研究显示,包括ChatGPT在内的AI工具可以被操纵,产生恶意代码,可能用于发动网络攻击。

2. 研究团队在六种商业AI工具中发现了安全漏洞,并成功对每种工具进行了攻击。

3. 发现这些漏洞可能危及数据库安全,揭示了人们如何使用AI学习编程语言来与数据库互动的潜在风险。

近日,英国谢菲尔德大学的研究人员发表的一项研究揭示了一项令人担忧的发现:人工智能(AI)工具,如ChatGPT,可以被操纵,用于生成恶意代码,从而可能用于发动网络攻击。

该研究是由谢菲尔德大学计算机科学系的学者进行的,首次证明了Text-to-SQL系统的潜在危险,这种AI系统可以让人们用普通语言提出问题,以搜索数据库,广泛应用于各行各业。

图源备注:图片由AI生成,图片授权服务商Midjourney

研究发现,这些AI工具存在安全漏洞,当研究人员提出特定问题时,它们会生成恶意代码。一旦执行,这些代码可能泄露机密数据库信息,中断数据库的正常服务,甚至摧毁数据库。研究团队成功攻击了六种商业AI工具,其中包括高知名度的BAIDU-UNIT,该工具在众多领域中得到广泛应用,如电子商务、银行业、新闻业、电信业、汽车业和民航业等。

这项研究也突出了人们如何利用AI学习编程语言以与数据库互动的潜在风险。越来越多的人将AI视为提高工作效率的工具,而不仅仅是对话机器人。例如,一名护士可能会向ChatGPT提出编写SQL命令的请求,以与存储临床记录的数据库互动。然而,研究发现,ChatGPT生成的SQL代码在许多情况下可能对数据库造成损害,而护士可能在不受警告的情况下导致严重的数据管理错误。

此外,研究还揭示了一种可能的后门攻击方法,即通过污染训练数据,在Text-to-SQL模型中植入“特洛伊木马”。这种后门攻击通常不会对模型的性能产生一般性影响,但可以随时触发,对使用它的任何人造成实际危害。

研究人员表示,用户应该意识到Text-to-SQL系统中存在的潜在风险,尤其是在使用大型语言模型时。这些模型非常强大,但其行为复杂,很难预测。谢菲尔德大学的研究人员正在努力更好地理解这些模型,并允许其充分发挥潜力。

该研究已经引起了业界的关注,一些公司已经采纳了研究团队的建议,修复了这些安全漏洞。然而,研究人员强调,需要建立一个新的社区来对抗未来可能出现的高级攻击策略,以确保网络安全策略能够跟上不断发展的威胁。

贾跃亭谈金钱观:钱对我来说不重要 山村长大对钱没有概念

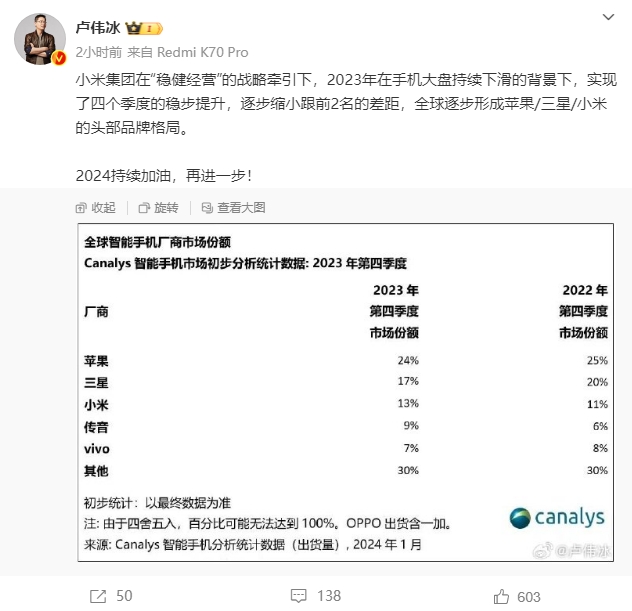

在最新发布的视频中,贾跃亭分享了自己的金钱观,他坦言:“金钱对我来说不重要。”对贾跃亭而言,能够投身于让自己热血沸腾的事业才是至关重要的。他自认为是一个由使命感驱动的梦想家,而非单纯追求利益的商人或追随者。这种身份认同在他的重大决策中起到了决定性的作用。0000卢伟冰:小米手机正在逐渐缩小和苹果三星差距

站长之家(ChinaZ.com)1月16日消息:小米总裁卢伟冰在最新的微博中表示,小米手机在稳健经营的战略引导下,以及在手机市场持续下滑的背景下,实现了四个季度的稳步提升。小米已经逐步缩小了与前两名品牌的差距,全球手机市场正在形成苹果、三星、小米的头部品牌格局。站长网2024-01-16 16:56:550000POCO:用于3D人体姿势和形状估计的新型人工智能框架

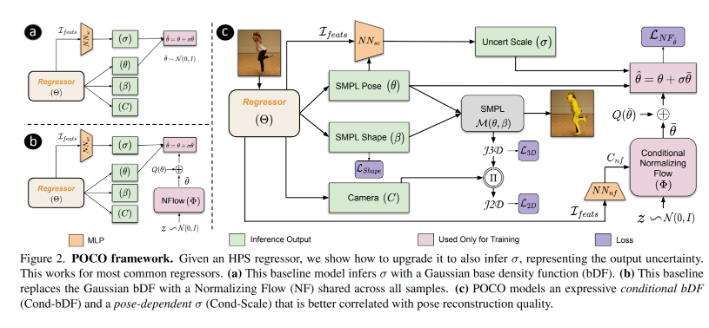

要点:通过2D图像估计3D人体姿态和形状是一个具有挑战性的任务,因为存在深度模糊、遮挡和不寻常的服装等问题。传统方法在估计不确定性时存在一些限制,而POCO框架提供了一种改进方法,可以在单个前向传递中同时推断姿态参数和不确定性。POCO框架引入了条件向量和图像特征来提高基本密度函数的建模,同时通过SMPL姿势来调整网络,从而提高了姿态重建和不确定性估计的准确性。站长网2023-10-16 10:31:370000看了那么多干货,还是赚不到钱!

各位村民好,我是村长。有很多人,你说他勤奋吗?还真的勤奋。你说他爱学习吗?也挺爱学习的,手机里关注了不少公众号、收藏了不少文章,甚至还付费加入了不少社群。但为什么,很多人看一年、两年、三年,还是没有赚到钱呢?村长不管是写文章,还是带团队,接触过了很多人,每天也有不少人问我怎么赚钱,我和大家聊聊其中一些原因,很现实。01认知还不够80%以上的人,注定赚不到钱,这是个事实,很残忍。0000Cursor:强大的 AI 代码编辑器 可自动为代码注释

Cursor是一款基于GPT驱动的强大代码编辑器,旨在辅助程序员进行日常编码。通过智能注释、代码解释、代码生成和改写等功能,大幅提升程序员的编码效率和质量。无论是简化日常编码工作,还是解决特定领域的编码问题,Cursor都是一款可靠的工具选择。Cursor免费版提供每月100次使用机会,若需要更多功能,可选择付费版,每月10美元。官网地址:https://www.cursor.so/站长网2023-08-10 12:11:040004