Nvidia发布开源工具包NeMo Guardrails,使文本生成式AI“更安全”

站长网2023-04-27 09:50:090阅

为了追求“更安全”的文本生成模型,Nvidia 日前发布了开源工具包NeMo Guardrails,旨在使基于 AI 应用程序更加“准确、合理、切合主题和安全”。

Nvidia 应用研究副总裁 Jonathan Cohen 表示,该公司“多年来”一直致力于 Guardrails 的底层系统,但大约一年前才意识到它非常适用于 GPT-4和ChatGPT等模型。

Guardrails 包括代码、示例和文档,可为生成文本和语音的 AI 应用程序“增加安全性”。Nvidia 声称该工具包旨在与大多数生成语言模型一起使用,允许开发人员使用几行代码创建规则。

具体来说,Guardrails 可用于防止——或至少试图防止——模型偏离主题、以不准确的信息或极为负面的语言做出响应,以及与“不安全”的外部来源建立联系。例如,阻止搜索引擎聊天机器人链接到声名狼藉的学术期刊等等。

Cohen 还指出,Guardrails 最适用于“很擅长执行指令”的模型,例如 ChatGPT,并且使用流行的LangChain框架来构建 AI 驱动的应用程序。然而,Nvidia 承认该工具包并不完美,也无法涵盖所有问题。

虽然 Guardrails 是一个开源版本,但 Nvidia 更希望其它公司为其托管版本付费。

0000

评论列表

共(0)条相关推荐

Snapchat 的 My AI 已经吸引了 1.5 亿用户 人工智能可提升广告业务

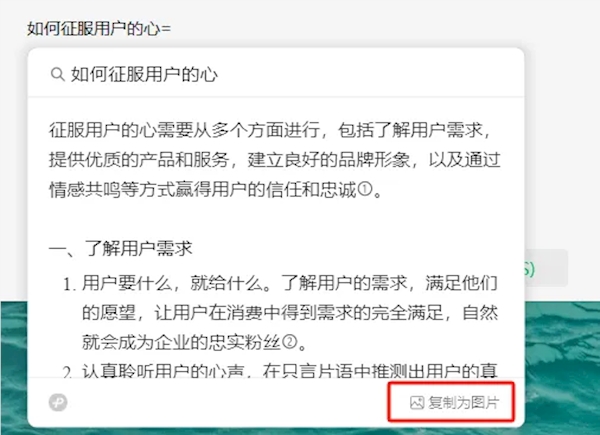

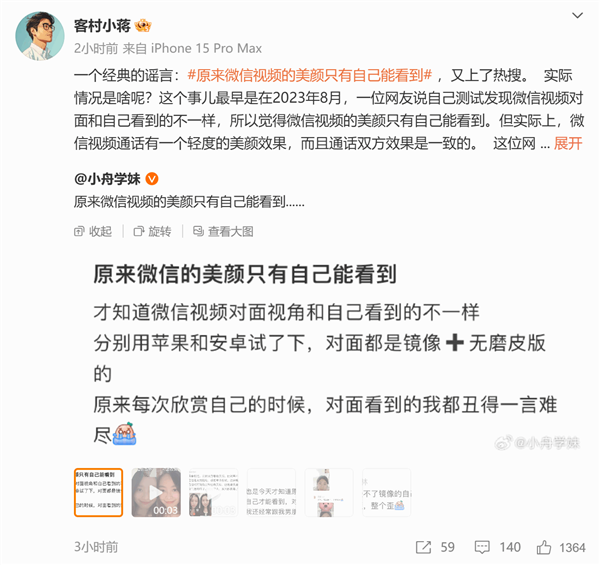

站长之家(ChinaZ.com)6月21日消息:Snapchat首席执行官EvanSpiegel表示,公司对人工智能(AI)的应用可以提升其广告业务。图片来自Snap站长网2023-06-22 12:28:040000微信输入法上线“一键AI问答”功能 基于腾讯混元大模型

站长之家(ChinaZ.com)6月26日消息:微信官方近日宣布,其输入法软件已迎来全新升级,正式上线了一键AI问答”功能,该功能基于腾讯混元大模型,为用户提供前所未有的智能交互体验。用户只需在微信聊天框中输入内容后添加一个“=”符号,便能迅速获得AI的智能回答。无论是查询信息、解答疑惑,还是进行日常闲聊,AI问答功能都能迅速给出精准的回应,极大地提升了用户的使用效率和便利性。站长网2024-06-26 22:44:140000优酷申请注册妙鸭相机商标

天眼查App显示,近日,北京优酷科技有限公司申请注册多枚“妙鸭相机”文字及图形logo商标,当前商标状态均为申请中。据媒体此前报道,近期爆火的AI应用“妙鸭相机”实为优酷内部创业项目,优酷背后为阿里大文娱。天眼查显示,妙鸭相机关联公司未序网络科技(上海)有限公司的法定代表人张龙同时是优酷视频(西安)传媒科技有限公司的法定代表人、执行董事。站长网2023-08-09 15:51:000000腾讯广告:微信小游戏已支持 PC 端推广

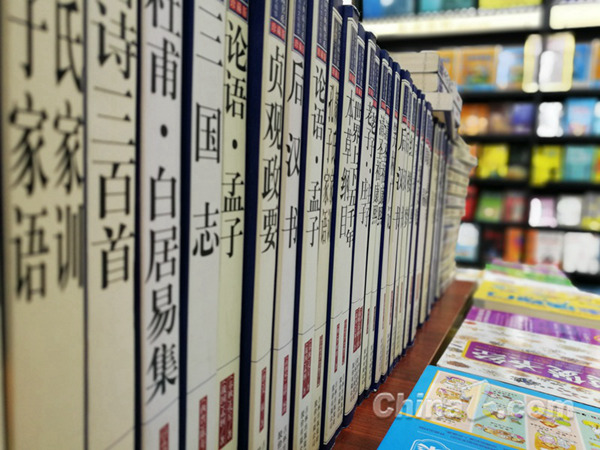

腾讯广告团队近日宣布,微信小游戏现已支持PC端推广,为小游戏广告主提供了触达海量PC端用户的机会。微信小游戏PC端的功能升级包括支持用户自由调整游戏尺寸和一键配置键盘鼠标映射,极大提升了游戏体验。此外,微信还提供了多端复访入口,实现了PC端与移动端的数据互通。这些升级使得PC端小游戏市场规模迅速增长,部分游戏的人均游戏时长已超过300分钟,活跃用户次日留存率高达80%。站长网2024-08-31 20:35:010000单号收益3000,闲鱼图书无货源项目保姆级实操攻略(黑)

过去,我一直觉得赚钱这件事,无非就是一个概率事件,只要做的项目够多试错的次数够多,赚钱就是一个必然事件。由于这套逻辑认知,从18年做ip到今天5年时间,我做了不少项目,拉新、中视频、淘客等等,赚了一些钱,也亏了不少钱。但站在5年后的今天,我再回顾过去,我觉得走了不少弯路,因为很多时候的一些项目只是在一个低水平上的重复,没有深耕也就很难深入这个行业,所以你说我成长了吗,某种程度上来说没有。站长网2023-05-04 09:16:070000