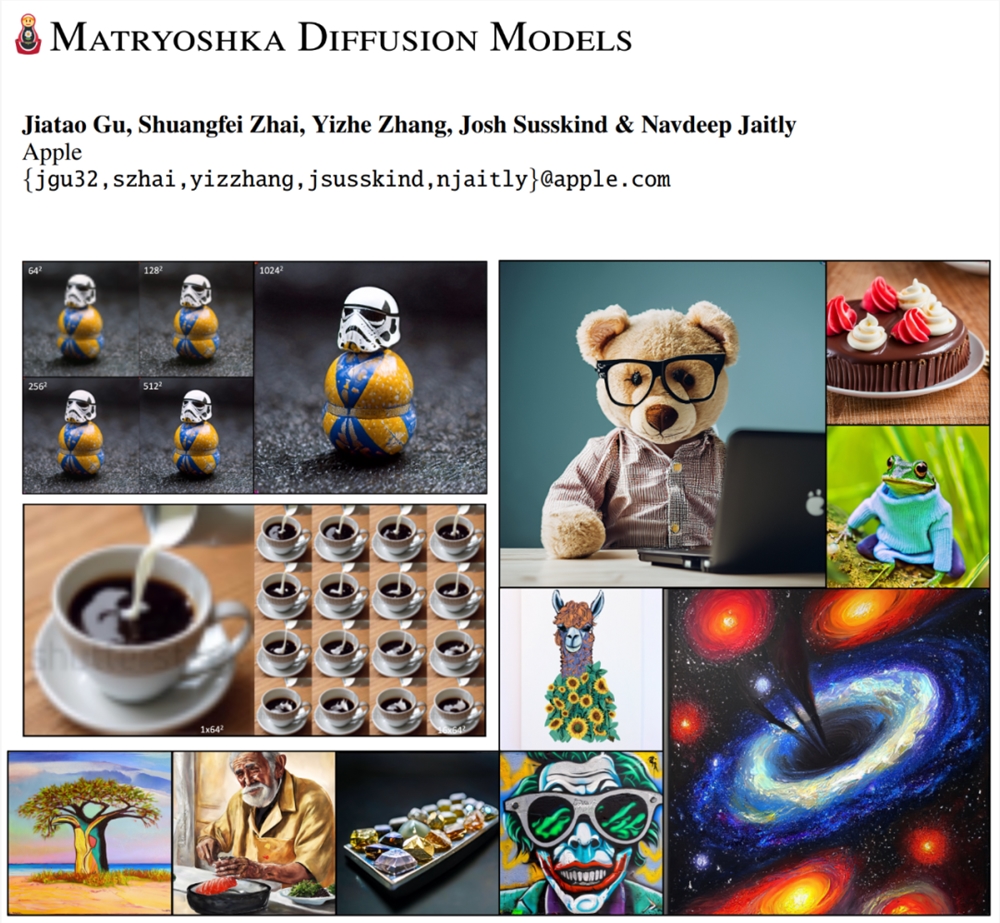

苹果文生图大模型亮相:俄罗斯套娃式扩散,支持1024x1024分辨率

习惯了 Stable Diffusion,如今终于又迎来一个俄罗斯套娃式(Matryoshka)Diffusion 模型,还是苹果做的。

在生成式 AI 时代,扩散模型已经成为图像、视频、3D、音频和文本生成等生成式 AI 应用的流行工具。然而将扩散模型拓展到高分辨率领域仍然面临巨大挑战,这是因为模型必须在每个步骤重新编码所有的高分辨率输入。解决这些挑战需要使用带有注意力块的深层架构,这使得优化更困难,消耗的算力和内存也更多。

怎么办呢?最近的一些工作专注于研究用于高分辨率图像的高效网络架构。但是现有方法都没有展示出超过512×512分辨率的效果,并且生成质量落后于主流的级联或 latent 方法。

我们以 OpenAI DALL-E2、谷歌 IMAGEN 和英伟达 eDiffI 为例,它们通过学习一个低分辨率模型和多个超分辨率扩散模型来节省算力,其中每个组件都单独训练。另一方面,latent 扩散模型(LDM)仅学习低分辨率扩散模型,并依赖单独训练的高分辨率自编码器。对于这两种方案,多阶段式 pipeline 使训练与推理复杂化,从而往往需要精心调整或进行超参。

本文中,研究者提出了俄罗斯套娃式扩散模型(Matryoshka Diffusion Models,MDM)它是用于端到端高分辨率图像生成的全新扩散模型。代码很快将释出。

论文地址:https://arxiv.org/pdf/2310.15111.pdf

该研究提出的主要观点是将低分辨率扩散过程作为高分辨率生成的一部分,通过使用嵌套 UNet 架构在多个分辨率上执行联合扩散过程。

该研究发现:MDM 与嵌套 UNet 架构一起实现了1)多分辨率损失:大大提高了高分辨率输入去噪的收敛速度;2)高效的渐进式训练计划,从训练低分辨率扩散模型开始,按照计划逐步添加高分辨率输入和输出。实验结果表明,多分辨率损失与渐进式训练相结合可以让训练成本和模型质量获得更好的平衡。

该研究在类条件图像生成以及文本条件图像和视频生成方面评估了 MDM。MDM 让训练高分辨率模型无需使用级联或潜在扩散(latent diffusion)。消融研究表明,多分辨率损失和渐进训练都极大地提高了训练效率和质量。

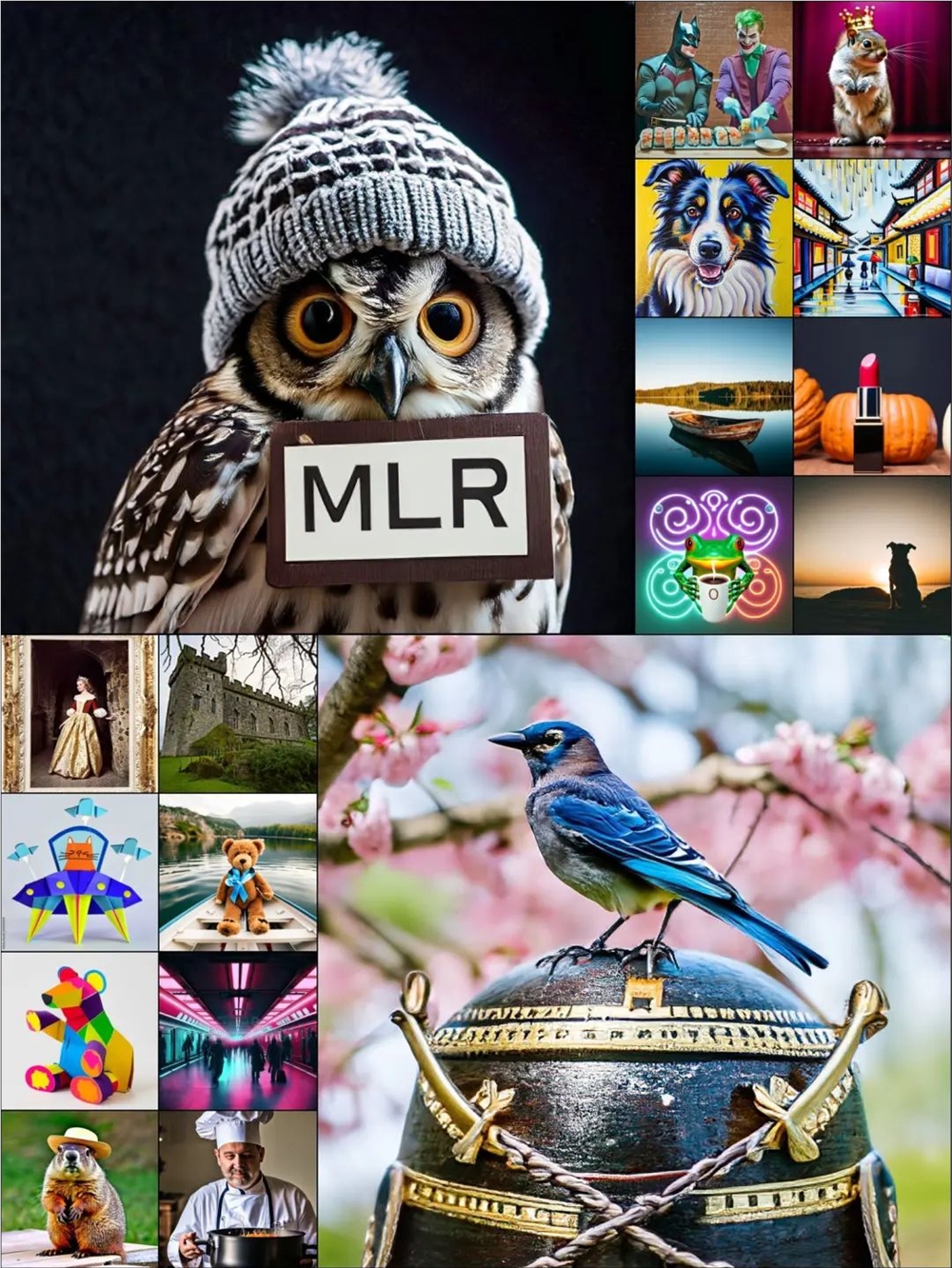

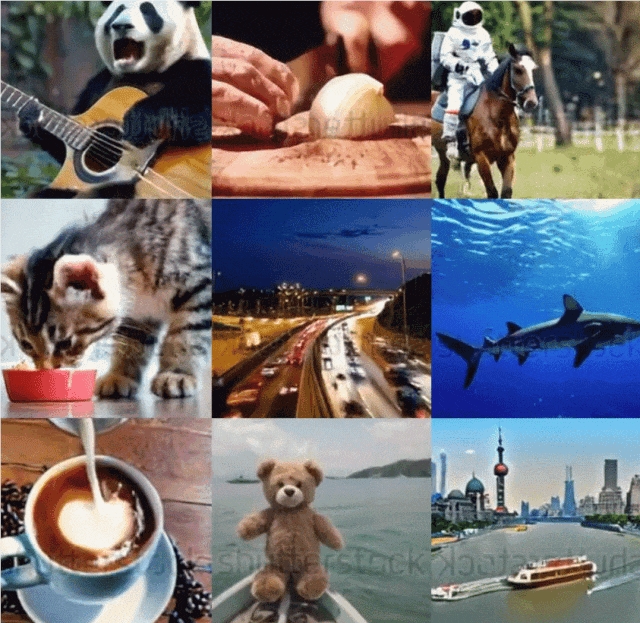

我们来欣赏以下MDM 生成的图片和视频。

方法概览

研究者介绍称,MDM 扩散模型在高分辨率中进行端到端训练,同时利用层级结构的数据形成。MDM 首先在扩散空间中泛化了标准扩散模型,然后提出了专用的嵌套架构和训练流程。

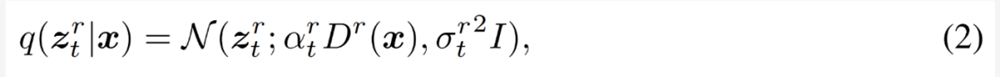

首先来看如何在扩展空间对标准扩散模型进行泛化。

与级联或 latent 方法的不同之处在于,MDM 通过在一个扩展空间中引入多分辨率扩散过程,学得了具有层级结构的单个扩散过程。具体如下图2所示。

具体来讲,给定一个数据点 x ∈ R^N,研究者定义了与时间相关的隐变量 z_t = z_t^1, . . . , z_t^R ∈ R^N_1 ...NR。

研究者表示,在扩展空间中进行扩散建模有以下两点优点。其一,我们在推理期间通常关心全分辨率输出 z_t^R,那么所有其他中等分辨率被看作是额外的隐变量 z_t^r,增加了建模分布的复杂度。其二,多分辨率依赖性为跨 z_t^r 共享权重和计算提供了机会,从而以更高效的方式重新分配计算,并实现高效训练和推理。

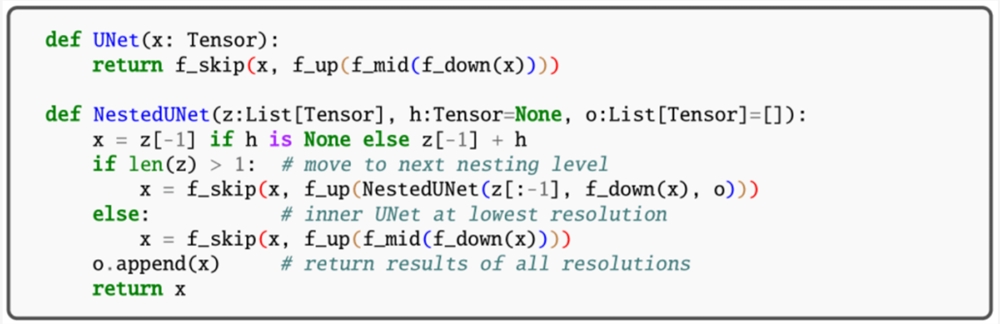

接下来看嵌套架构(NestedUNet)如何工作。

与典型的扩散模型类似,研究者使用 UNet 网络结构来实现 MDM,其中并行使用残差连接和计算块以保留细粒度的输入信息。这里的计算块包含多层卷积和自注意力层。NestedUNet 与标准 UNet 的代码分别如下。

除了相较于其他层级方法的简单性,NestedUNet 允许以最高效的方式对计算进行分配。如下图3所示,研究者早期探索发现,当以最低分辨率分配大部分参数和计算时,MDM 实现了明显更好的扩展性。

最后是学习。

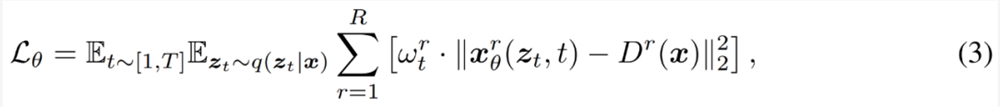

研究者使用常规去噪目标在多个分辨率下训练 MDM,如下公式 (3) 所示。

这里用到了渐进式训练。研究者按照上述公式 (3) 直接对 MDM 进行端到端训练,并展示出了比原始基线方法更好的收敛性。他们发现,使用类似于 GAN 论文中提出的简单渐进式训练方法,极大地加速了高分辨率模型的训练。

这一训练方法从一开始就避免了高成本的高分辨率训练,加速了整体收敛。不仅如此,他们还合并了混合分辨率训练,该训练方法在单个 batch 中同时训练具有不同最终分辨率的样本。

实验及结果

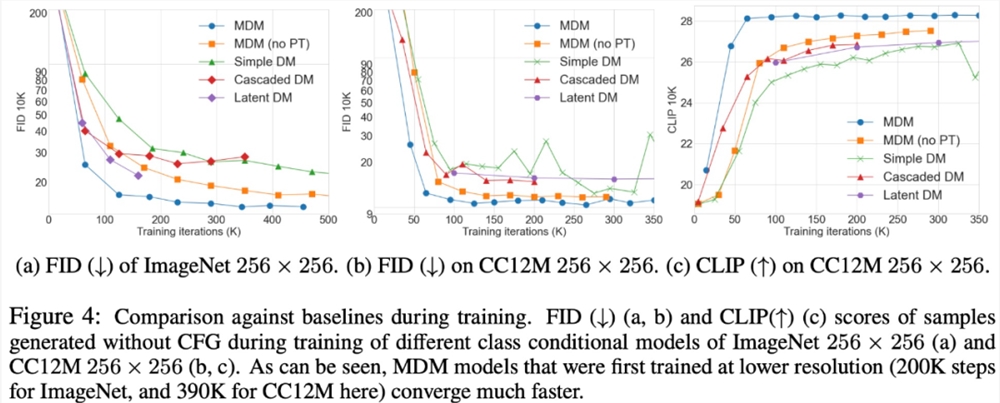

MDM 是一种通用技术,适用于可以逐步压缩输入维度的任何问题。MDM 与基线方法的比较如下图4所示。

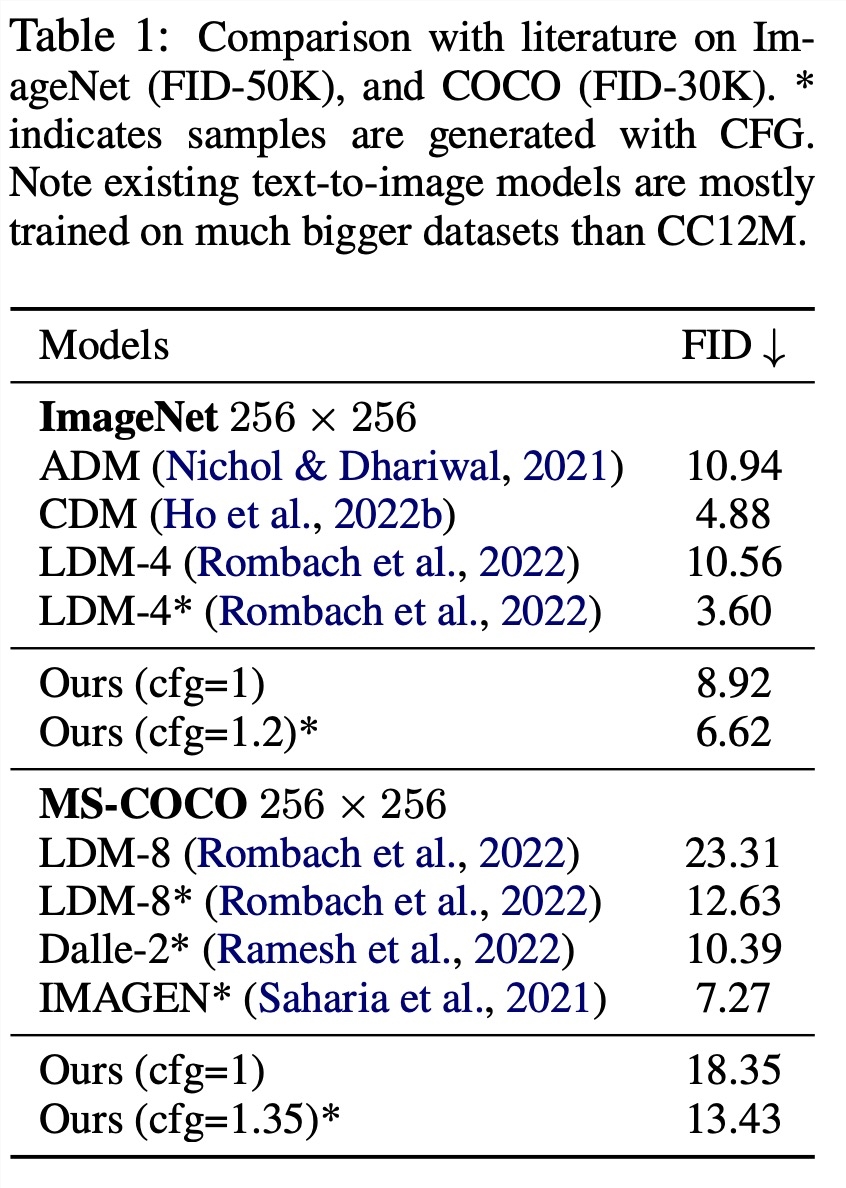

表1给出了在 ImageNet(FID-50K)和 COCO(FID-30K)上的比较结果。

下图5、6、7展示了 MDM 在图像生成(图5)、文本到图像(图6)和文本到视频(图7)方面的结果。尽管是在相对较小的数据集上进行训练的,但 MDM 仍显示出生成高分辨率图像和视频的强大零样本(zero-shot)能力。

感兴趣的读者可以阅读论文原文,了解更多研究内容。

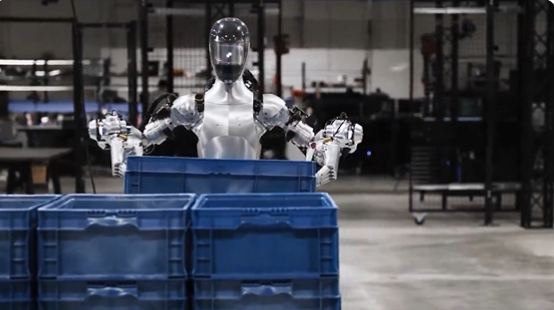

Figure公司发布Figure 01人形机器人最新演示 可完全自动化执行任务

Figure公司最近推出了Figure01人形机器人的演示,展示了这款机器人可以完全自动化地执行现实世界的任务。这一更新主要包括实现了自主导航和基于力的操控技术。通过这些技术,Figure01机器人能够在不需要人为干预的情况下自主导航,同时利用基于力的操控技术来执行任务。站长网2024-02-27 10:48:250001火光冲天!一辆特斯拉电动汽车突然自燃:出事前一天刚换电池

快科技11月11日消息,据国内媒体报道称,一辆特斯拉电动汽车突然发生自燃,现场火光一片,很是惨烈。报道中提到,事情发生在美国得克萨斯州北部城市普莱诺,当地一辆特斯拉电动汽车突然发生自燃事故,所幸没有造成人员伤亡。按照车主的说法,出事前一天他刚刚给自己的爱车更换了电池,当车主再次检查车辆时,发现电池起火燃烧,随后整辆车被烧毁。这也引发了网友的热议,而电动车自燃已经不是头一次了。站长网2023-11-12 10:25:040002微信公众号已支持插入视频号小店商品卡片

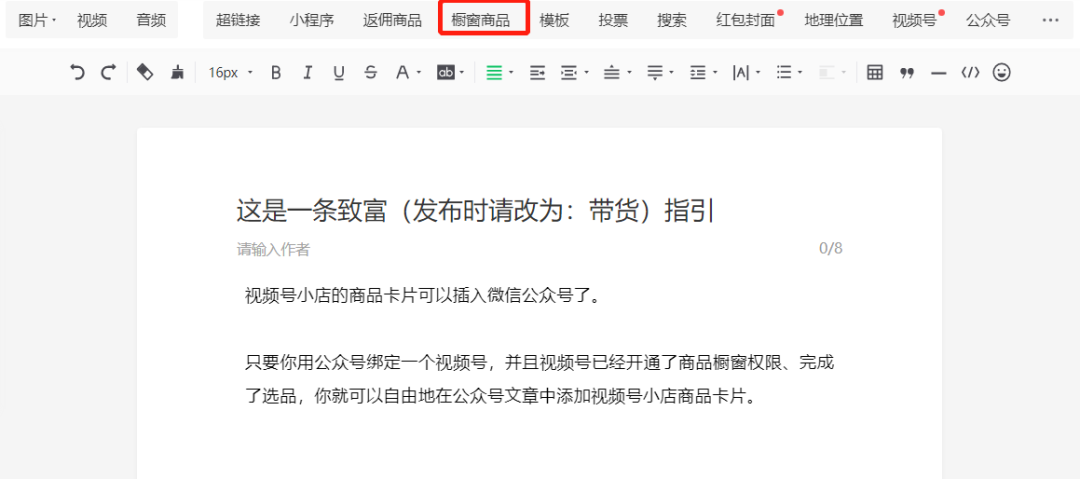

据微信官方消息,目前,视频号小店的商品卡片可以插入微信公众号了。只要公众号绑定一个视频号,并且视频号已经开通了商品橱窗权限、完成了选品,就可以在公众号文章中添加商品卡片。据悉,公众号绑定视频号,且视频号开通“商品橱窗”功能后,就可以接入该功能。具体操作流程如下:1.怎么插入?在公众号内容编辑页,点击上方功能栏“橱窗商品”,选择要插入的商品即可插入到文章中。2.怎么替换?站长网2023-05-11 10:30:320000Hinton为拒马斯克offer扯谎挂电话,警告AI取代人类比想象中快30年

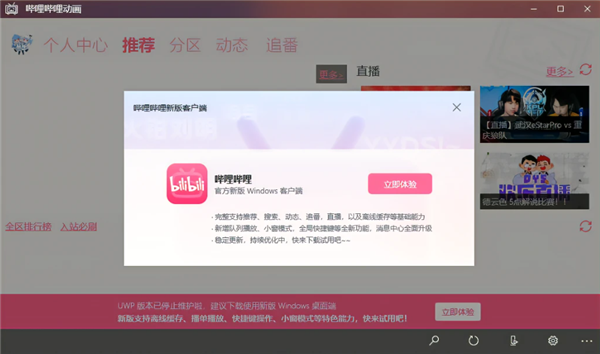

我和马斯克友尽了。GeoffreyHinton老爷子——图灵奖得主、深度学习发明人、AI三巨头、Ilya之师,在最新专访中透露出这个令人心碎的消息。就在这两天,Hinton接受了多家媒体的专访,既有老生常谈的内容,即他对AI发展安全的担忧;也有一些新的话题和八卦。他提到了老朋友马斯克,俩人一直以来都是AI威胁论的支持者。图源备注:图片由AI生成,图片授权服务商Midjourney站长网2024-06-17 11:41:470000只剩Windows版了!B站正式宣布UWP版停止维护

快科技4月9日消息,B站在近日的一次更新后,终止了UWP版本客户端的维护。目前,用户登陆B站的UWP客户端,将无法加载视频等内容信息,并显示弹窗,建议用户尝试新的Windows客户端。新的Windows客户端在UI设计风格上与此前的UWP版完全不同,且在诸如视频下载等功能上也存在一定差异。站长网2023-04-12 14:03:570007