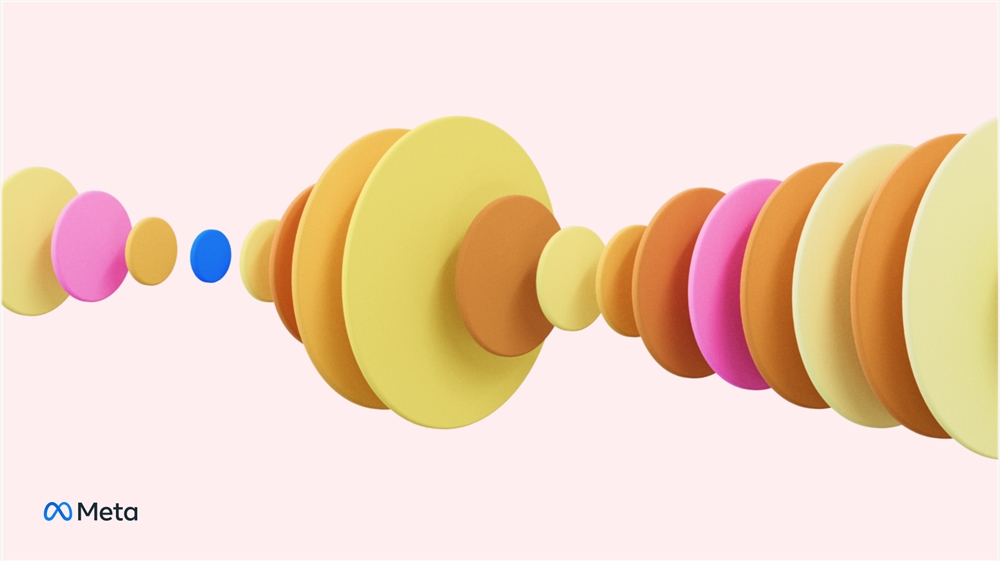

Meta AI实验室推三项新AI项目庆祝成立十周年:Ego-Exo4D、Audiobox等

**划重点:**

1. 🌐 **Ego-Exo4D:** Meta发布支持视频学习和多模态感知的数据集,涵盖运动、音乐、烹饪等复杂人类活动,可用于增强现实、机器学习和社交网络。

2. 💬 **Seamless Communication:** 推出四个AI研究模型,旨在跨越语言界限实现更自然、真实的表达和快速翻译,包括保留语音表达和语境的SeamlessExpressive等功能。

3. 🎶 **Audiobox:** Meta的新音频生成模型,通过语音输入和自然语言文本提示生成声音和音效,以创造定制的音频文件,为研究人员和学术机构提供先进的音频生成研究支持。

为庆祝Meta基础人工智能研究(FAIR)团队成立十周年,公司隆重推出三个创新的人工智能项目,展示了引人注目的演示。

Ego-Exo4D:

官方项目介绍网址:https://ai.meta.com/blog/ego-exo4d-video-learning-perception/

该项目以数据集及基准测试的形式呈现,旨在支持视频学习和多模态感知的人工智能研究。由Meta的FAIR、Project Aria,以及来自全球15所大学的合作伙伴在两年内共同收集,Ego-Exo4D捕捉了佩戴Project Aria头戴设备的参与者的“自我中心”视角和周围摄像机的“外部中心”视角。

这一数据集聚焦于复杂的人类活动,如运动、音乐、烹饪、舞蹈和自行车维修。Meta认为,该数据集在增强现实系统、机器人学习以及社交网络等领域具有广泛应用前景。1,400多小时的视频数据将于12月以开源形式发布,并计划于明年进行Ego-Exo4D公开基准竞赛。

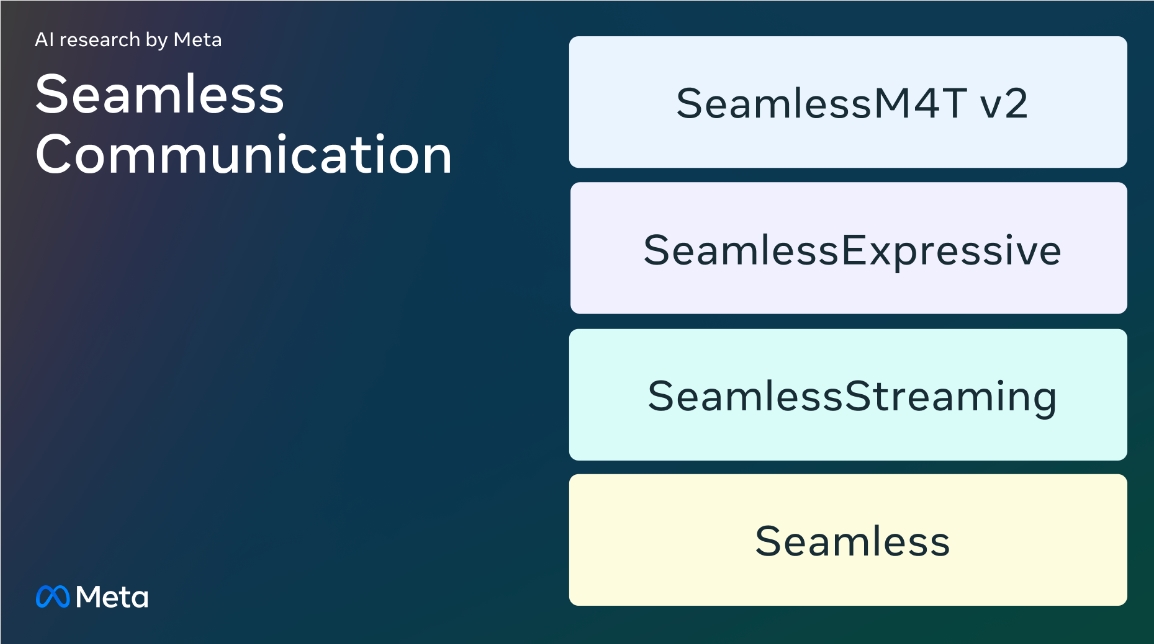

Seamless Communication:

官方项目介绍网址:https://ai.meta.com/blog/seamless-communication/

该项目旨在通过四个AI研究模型实现更自然、真实的跨语言交流。包括保留语音表达和语境的SeamlessExpressive,以及提供约两秒延迟的语音和文本翻译的SeamlessStreaming。此外,SeamlessM4T v2是一个多语言、多任务的模型,用于轻松实现语音和文本之间的交流。最终,Seamless将集成SeamlessExpressive、SeamlessStreaming和SeamlessM4T v2的功能于一个模型中。

Meta还发布了SeamlessExpressive的演示,用户可以在其中将其语音翻译成其他语言,增强了跨语言沟通的交互性。

官方演示网址:https://seamless.metademolab.com/expressive/

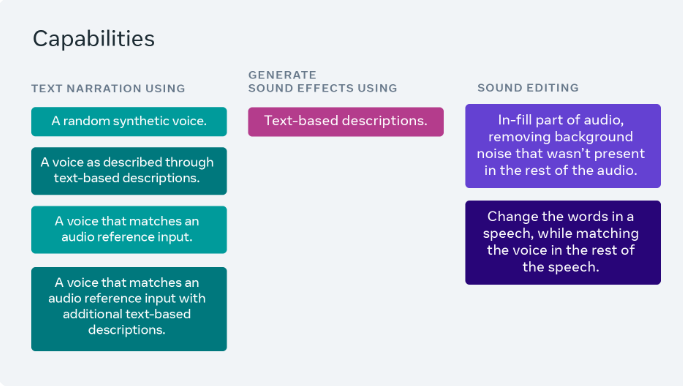

Audiobox:

官方项目介绍网址:https://ai.meta.com/blog/audiobox-generating-audio-voice-natural-language-prompts/

这是Meta全新的音频生成模型,通过结合语音输入和自然语言文本提示,能够生成声音和音效,从而更轻松地创建用于不同用途的定制音频文件。相比其前身Voicebox,Audiobox通过允许用户使用自然语言提示来创建所需的声音或语音类型,提供了更强的可控性。

Meta表示,该模型将首先提供给一组选择的研究人员和学术机构,以推动音频生成研究的发展,并确保人工智能的负责任发展。

这三个项目的推出标志着Meta FAIR团队十年来在人工智能领域取得的巨大成就,并为未来的技术发展和创新奠定了坚实基础。

百度MEG进行新一轮组织调整:文库升级为BU,赵世奇回归负责搜索

站长之家(ChinaZ.com)2月23日消息:据36氪消息,百度今日宣布,其移动生态业务群组(MEG)进行新一轮的组织调整,具体调整如下:0000博客门户网站Medium禁止AI内容,称这里是“人类写作的家园”

“我们是人类写作的家园。”Medium内容总监斯科特·兰姆(ScottLamb)在公司博客上表示,人们更喜欢阅读人们撰写的文本。人工智能辅助写作是“允许的”,但不再“受欢迎”。兰姆说,完全由人工智能编写的文本并不适合Medium。站长网2023-08-03 16:35:3400001分钟做出苹果Vision Pro「官网」?上班8小时搞出480个网页,同事被卷疯了

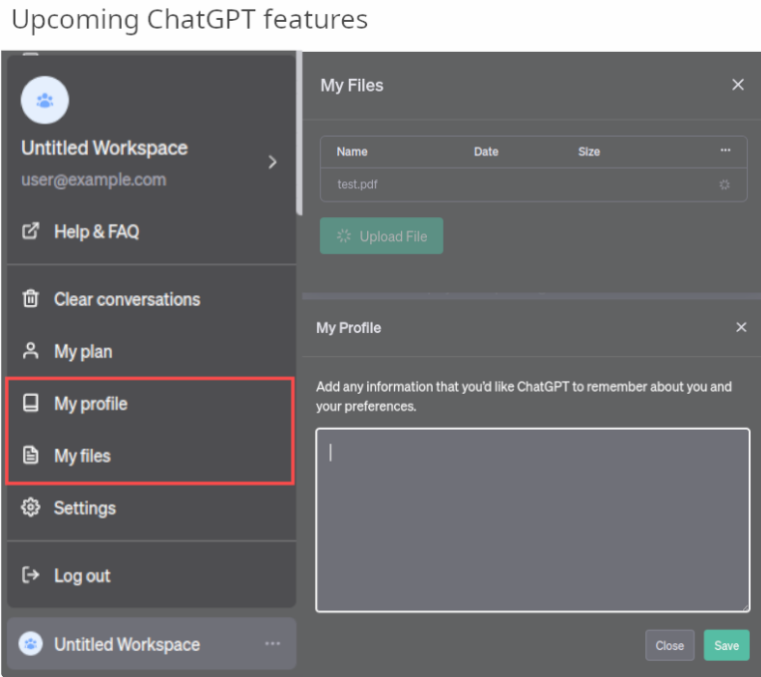

【新智元导读】给苹果VisionPro官网做个设计?一分钟生成,零门槛可用。最近,全世界都被苹果的MR头显给炸场了。把这么多复杂硬件整合成如同一个piece的产品,VisionPro简直堪称苹果的创二世纪。如此炸裂的效果,但是却要等到明年才小规模开售,小编按捺不住内心的激动,忍不住想给它做个销售网站。站长网2023-06-10 03:09:530000ChatGPT新功能或将推出:工作区、文件上传、配置文件

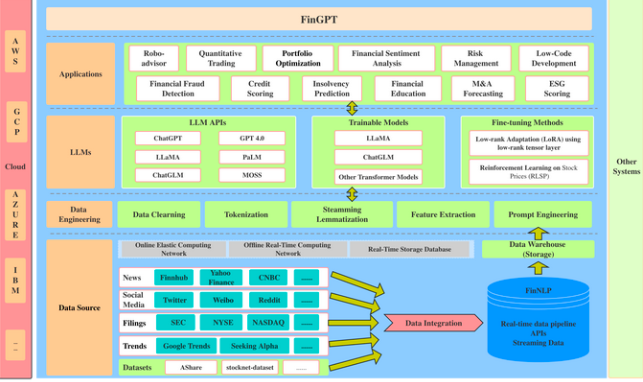

有用户发现,OpenAI似乎正在为ChatGPT准备另一次更新。据报道,Reddit用户“kocham_psy”在ChatGPT的源代码中第一眼看到了ChatGPT可能新版本的界面。他声称,自己使用了一个脚本来欺骗网站认为他的帐户可以访问所有功能。其在新近上线的聊天分享功能正式发布前一周就发现了。站长网2023-06-12 17:12:550000专为金融打造!开源语言模型FinGPT 提供机器人顾问服务

最近,一篇介绍开源人工智能模型FinGPT的论文引起了广泛关注。该模型是专门为金融领域开发的,旨在为金融研究和开发提供易于使用的工具,包括自动化数据管理和类似机器人顾问和算法交易等应用的潜力。项目地址:https://github.com/ai4finance-foundation/fingpt站长网2023-08-21 16:18:420000