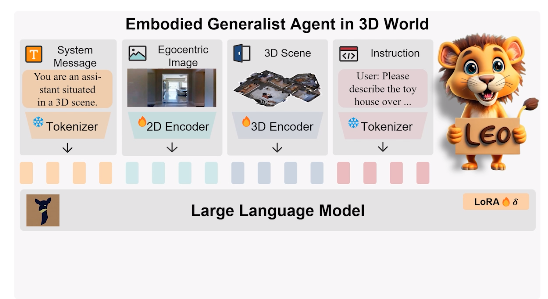

首个三维具身通才智能体LEO:全面掌握感知、推理、规划、行动

要点:

LEO是首个具身通才智能体,以GPT-4等大语言模型为基础,实现了在三维世界中的感知、推理、规划、行动等多任务多模态能力。

该研究填补了多模态大语言模型在三维世界任务上的空白,通过高效学习策略和数据生成方法,构建了一个能够在真实场景中应用的通才智能体。

LEO在三维场景问答、物体描述、具身推理等任务上表现优异,具备在家庭助理、智能导航、机器人操作等领域广泛应用的潜力。

近年来,多模态大语言模型在自然语言处理、视觉理解和机器人领域取得了显著进展。然而,这些模型主要基于二维图片和文本数据,对于理解和交互于三维世界的任务存在一定的欠缺。为解决这一问题,北京通用人工智能研究院携手北京大学、卡耐基梅隆大学和清华大学的研究人员,提出了具备感知、推理、规划、行动等多任务多模态能力的首个三维世界具身通才智能体LEO。

论文链接:https://arxiv.org/abs/2311.12871

项目主页:https://embodied-generalist.github.io/

代码链接:https://github.com/embodied-generalist/embodied-generalist

LEO的核心设计思想是以大语言模型为基础,在两个关键阶段进行训练:三维视觉-语言对齐和视觉-语言-动作指令微调。通过采用共享的架构和权重,LEO能够在不同任务之间实现无缝切换,构建了一个统一的处理框架。在数据集的收集方面,研究团队通过两阶段训练策略,包括物体级别和场景级别的大规模数据集,为LEO的训练提供了坚实基础。

研究的主要贡献体现在三个方面:首先,构建了在三维世界中完成感知、定位、推理、规划和动作执行的LEO。其次,提出了高效的学习策略,通过将以物体为中心的三维表征与语言模型相结合,成功打通了视觉-语言-动作的通道。最后,研发了生成高质量三维视觉语言数据的方法,构建了大规模的视觉-语言-动作指令微调数据集。

LEO的应用前景广泛,作为未来的家庭助理,它能够与人进行交互,调整家居布局、帮助找到物品、提供各种问题的建议。在导航和操控能力方面,LEO可应用于购物中心的智能引导、家居自动化任务以及物流中心的物品整理和搬运,展现出巨大的应用价值。

LEO的出现标志着具身通才智能体在三维世界任务上取得了新的突破,为实现通用人工智能迈出了重要一步。

大模型伪装「潜伏特工」学会欺骗!OpenAI劲敌重磅研究震惊马斯克

最近,Anthropic的研究者发现:一旦我们教会LLM学会骗人,就很难纠正它了。它会在训练过程中表现得「人畜无害」,随后神不知鬼不觉地输出恶意代码!如果想要纠正它,它的欺骗行为只会更变本加厉。不要教LLM学会骗人!不要教LLM学会骗人!不要教LLM学会骗人!因为后果可能会很严重,甚至超出人类的想象。站长网2024-01-16 07:01:320000李飞飞团队推零样本360度场景合成技术ZeroNVS

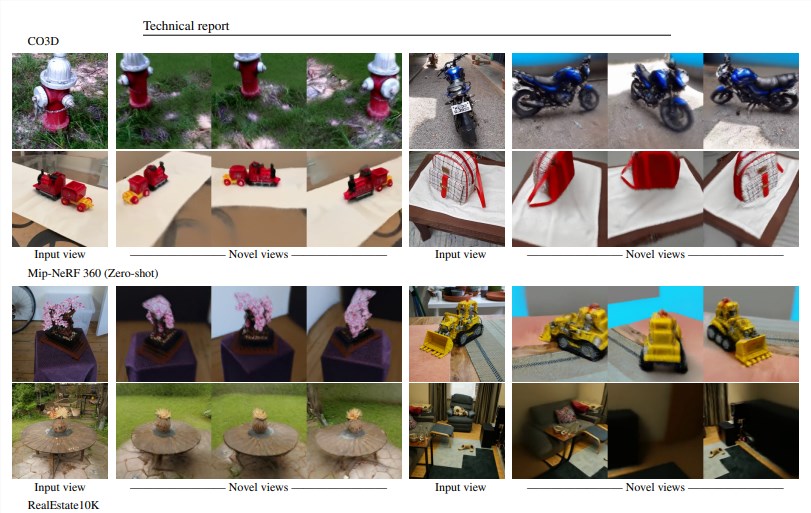

要点:1.斯坦福和谷歌团队提出了ZeroNVS,一种能够从单个图像实现零样本360度试图合成的新技术。2.ZeroNVS利用3D感知扩散模型和SDS蒸馏来生成逼真且多样化的合成图像,聚焦于场景而不是物体。3.研究人员使用不同的基准数据集进行评估,结果表明ZeroNVS在零样本性能方面明显领先于其他方法,特别是在LPIPS指标上。站长网2023-11-06 09:43:560000弹幕互动直播有哪些新机遇?平台、公会及厂商这么说......

8月4日,新播场在长沙举办了一场弹幕互动直播公会交流会。本次交流会邀请了快手、腾讯、淘宝直播等多家平台,OST娱乐等多家头部公会,以及傲宇互娱、众邀互动等多家头部弹幕游戏厂商。本次活动共有三个环节:平台分享、公会分享和厂商分享。不同身份的玩家齐聚一堂,不仅共同探讨了弹幕互动玩法爆火的核心逻辑,还分析了弹幕互动会带给娱乐直播行业发展的机遇。站长网2023-08-08 14:03:180002蔚来与路特斯达成充换电领域战略合作

蔚来汽车今日宣布,已与路特斯汽车达成充换电领域的战略合作,旨在全方位、多层次地深化双方在充换电产业的合作。此次合作涵盖了电池标准、充换电技术、电池资产管理及运营、充换电服务网络建设及运营、充换电车型研发及定制以及充电互联互通等多个领域。此前,蔚来汽车已经与路特斯汽车的母公司吉利汽车展开了充电网络互联互通合作,这一合作使得吉利自建的充电网络能够与蔚来实现无缝对接。站长网2024-04-25 21:41:060000谷歌 AR 软件负责人离职:期待增强现实与生成式 AI 融合的机会

谷歌增强现实团队操作系统负责人MarkLucovsky已离开该公司。Lucovsky在周一的一条推文中表示,「增强现实领导层的变动以及谷歌对承诺和愿景的不稳定」是他决定离开的原因之一。站长网2023-07-12 09:09:580001