亚马逊研究人员利用深度学习增强神经网络分析复杂表格数据

划重点:

🔍 神经网络在处理异构列的表格数据时面临挑战

🔍 提出一种将表格特征转化为低频表示的方法

🔍 实验证明该方法能提升神经网络的性能和计算效率

亚马逊的研究人员在一篇论文中介绍了一种创新方法,旨在增强神经网络处理复杂表格数据时的性能。表格数据通常由行和列组成,看似简单,但当这些列在性质和统计特征上差异巨大时,就会变得复杂起来。

图源备注:图片由AI生成,图片授权服务商Midjourney

传统的神经网络由于对特定类型信息的偏好而难以理解和处理这些异构数据集。这种偏好限制了它们理解和解码复杂表格数据中微妙细节的能力。而且,神经网络的频谱偏好使得它们倾向于低频分量而不是高频分量。异构表格数据中错综复杂的相互关联特征构成了神经网络封装和处理的巨大挑战。

研究人员提出了一种新方法,将表格特征转化为低频表示,以减轻神经网络的频谱偏好,使其能够捕捉到理解这些异构表格数据中复杂信息的关键高频分量。实验通过对比分析表格数据和图像数据的傅里叶分量,提供了频谱和神经网络解码能力的见解。论文中提出的解决方案的一个关键方面是在减少频率以提升网络理解能力之间的微妙平衡,以及在改变数据表示时可能导致的重要信息损失或优化方面的负面影响。

论文展示了频率减少转换对神经网络解析表格数据能力的影响。图表和实证证据展示了这些转换如何显著提升网络的性能,特别是在解码合成数据中的目标函数方面。

研究还涉及对常用数据处理方法的评估,以及它们对频谱和网络学习的影响。这种细致的研究揭示了这些方法在不同数据集上的影响差异,强调了所提出的频率减少方法的卓越性能和计算效率。

论文总结了以下几点关键内容:

1. 神经网络在理解异构表格数据方面面临挑战,主要由于偏好和频谱限制。

2. 通过将表格特征转化为低频表示,可以增强神经网络的解析能力。

3. 经过实验证明,频率减少方法在提升网络性能和计算效率方面优于常用的数据处理方法。

这项研究为神经网络在处理复杂表格数据时的改进提供了新的思路和方法,有望在实际应用中取得更好的效果。

论文网址:https://www.amazon.science/publications/an-inductive-bias-for-tabular-deep-learning

北美巨头一周内裁员3万,至暗时刻的转机在哪?

“有些人会看到“危”,有些人则会看到“机”。”作者|Lexie编辑|Lu首图来源:BusinessInsider本周一,Facebook母公司Meta表示,将再裁员1万人,成为首家宣布第二轮大规模裁员的大厂。四个月前Meta刚刚裁员1万1千人;本周三,招聘平台巨头Indeed表示,预计将裁员约2,200人,占员工总数的15%;站长网2023-04-17 18:34:310000腾讯也没有想到,一个小小专利改变了整个互联网的交互习惯

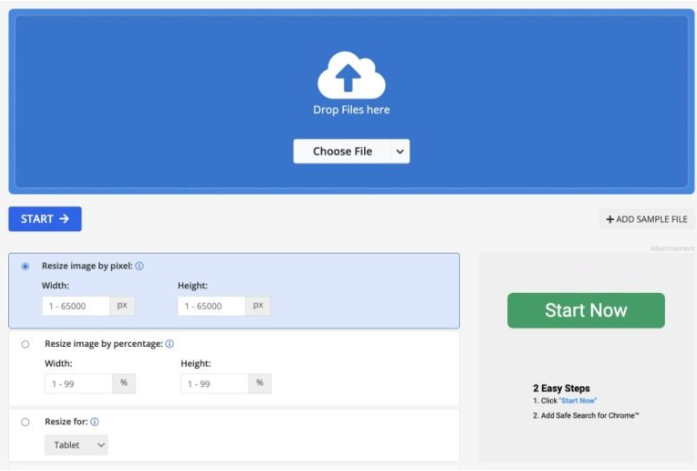

发现了一个大瓜——万万没有想到,腾讯有史以来的第一个专利,居然就是Pony申请的。而且这还不是个普通的专利吼~这个专利,叫「单窗口多页浏览装置」。所以这专利是干嘛的呢?网龄比较大的机友应该就知道。以前咱们用IE浏览器网上冲浪啊,每打开一个网页,都会创建并弹出一个新的IE窗口。这一个两个,可能还好。冲浪的时间一长,就会让整个屏幕混乱不堪...这好吗,这不好。站长网2023-05-23 18:22:1300007 个好用的免费AI图像缩放工具

AI图像缩放工具可以为设计人员提供简单的解决方案来优化和调整图像以满足不同的需求。无论是网页设计、社交媒体还是专业作品集,准确有效地调整图像大小的能力都至关重要。站长网2023-12-22 13:05:570000OpenAI试图驳回一起有关对ChatGPT侵权诉讼中的大部分主张

文章概要:1.OpenAI请求驳回六项主张中的五项2.OpenAI辩称大语言模型具有转化性质,应适用合理使用原则3.OpenAI计划就直接侵权主张进行法庭辩护OpenAI最近就ChatGPT及其底层语言模型GPT-3.5和GPT-4训练数据中使用受版权保护内容而遭起诉,提出动议驳回两起版权诉讼中的五项主张。站长网2023-08-30 11:31:340000AI视野:ElevenLabs发布“语音转语音”;realme GT5Pro 12月7日发布;Claude2.1被指严重虚标;清华大学提出全新加速训练大模型方法SoT

🤖📱💼AI应用ElevenLabs发布“语音转语音”ElevenLabs的语音生成式AI平台发布了“语音转语音”功能,用户可上传语音并自动转换为不同音色,实现声音的自由切换,为用户带来全新的语音生成体验。免费体验地址:https://elevenlabs.io/voice-changer【AiBase提要:】站长网2023-11-24 17:05:220001