CodeFuse微调框架MFTCoder升级v0.3.0版本 支持Mixtral等模型

MFTCoder 是蚂蚁CodeFuse开源的一种多任务微调框架,可以在多个任务上同时进行微调。它通过结合多种损失函数解决了多任务学习中的挑战。MFTCoder 具备高效训练特征,包括高效的数据 Tokenization 模式和支持 PEFT 微调,能提升微调训练速度并降低资源需求。

MFTCoder 在 v0.3.0版本中进行了重磅升级。

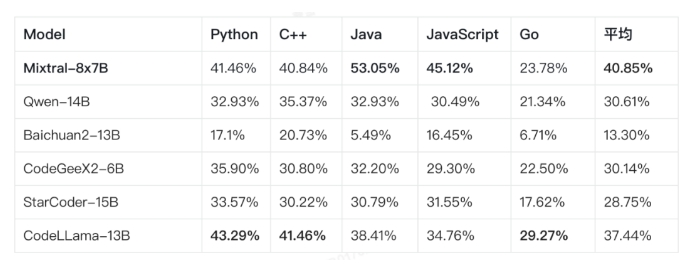

首先,它支持了 Mixtral 等更多的主流开源 LLMs 模型,如 Mistral、Deepseek-coder、Chatglm3等。这些模型经过 MFTCoder 微调后,在代码能力上有了显著的提升。

其次,新版本适配了最新的 transformers v4.36.0和 FlashAttention2v2.3.6,使得 MFTCoder 可以更好地利用最新的 Attention 实现,如 sliding_window Attention,进一步提升模型性能。

第三,MFTCoder-accelerate 框架在原有支持 Accelerate DeepSpeed 的基础上,增加了对 FSDP 的支持,提供了更多的选择。

最后,MFTCoder 引入了 Self-Paced Loss 作为新的收敛均衡技术,可以调整不同任务的权重,控制不同任务的收敛速度,实现多任务同时收敛。

通过多任务微调,CodeFuse-Mixtral-8x7B 在各种语言的 Pass@1评测中的性能得到了显著提升,达到40.9% ->52.8%。这使得 CodeFuse-Mixtral-8x7B 成为当前开源的非代码大模型中代码能力领先的模型之一。

项目地址:https://github.com/codefuse-ai/MFTCoder/tree/main/mftcoder_accelerate

魅族 20 INFINITY 无界版今日开售 起售价6299元

今日10点,魅族20INFINITY无界版将正式开售,可享3年质保至高24期免息,起售价6299元,16GB1TB售价8499元。据介绍,魅族20无界版,双面配备魅族泰坦玻璃,搭载特别定制6.79英寸2K21:9无界臻彩屏和Unibody无界蓝宝石镜片。整机中框采用Hybrid超轻量不锈钢,重量减轻30%,散热效率提升40%,抗摔表现提升4倍。站长网2023-06-12 17:12:560000Meta的MyoSuite2.0通过机器学习模仿幼儿移动

由MetaAI发布的MyoSuite2.0系列,与加拿大麦吉尔大学、美国东北大学和荷兰特文特大学的研究人员合作新项目。该项目将机器学习应用于生物力学控制问题,目的是展示人类水平的灵巧和敏捷。手臂和腿部是该团队迄今为止创建的最生理复杂的模型,协调大型和小型肌肉群是一个相当棘手的控制问题。该平台包括了一系列基线肌骨模型和开源基准任务,供研究人员尝试。站长网2023-08-16 09:25:200000萝卜快跑,能带着百度狂飙?

十年押注,一朝见果。深耕无人驾驶领域11年后,百度在武汉秀了一把硬实力。7月10日,“萝卜快跑订单疯涨”登上微博热搜,同时#萝卜快跑有望在无人驾驶网约车商业模式上实现盈利##萝卜快跑7.1公里只要4.99元#等相关新闻话题近日频频引发讨论。具体原因,据了解,最近“萝卜快跑”在武汉市全无人订单量也迎来了爆发式增长,单日单车峰值超20单,达到传统出租车司机平均日单量水平。0001Adobe发布生成式AI调查:马来西亚企业落后了

划重点:1.📊马来西亚企业在生成式AI领域需要迎头赶上,Adobe最新研究揭示了企业在提升客户体验方面的不足。2.🧩生成式AI对于客户满意度和竞争优势至关重要,然而,调查突显出企业与客户需求之间存在差距。3.📉由于预算有限,马来西亚企业削减了营销和客户体验方面的开支,这导致了生成式AI战略的滞后,不符合消费者期望和员工采用速度。站长网2023-11-06 10:47:540000Vary-toy:具有高级视觉词汇视觉语音模型 适用于标准GPU

划重点:📌挑战与潜力:大型视觉语言模型(LVLMs)在计算机视觉(CV)和自然语言处理(NLP)交叉任务中表现出色,但在图像感知能力方面仍有潜力待发。📌模型结构:目前的LVLMs通常采用图像标记作为前缀或交叉注意力进行特征融合。然而,模型的效率可能受到视觉词汇网络在编码视觉信号方面的限制。站长网2024-01-31 11:41:340000