3万亿的开放数据集AI2 Dolma发布

即使有许多公开的数据集,也缺乏足够的规模来训练最先进的模型。艾伦人工智能研究所的 Dolma 数据集旨在实现这一目标,以便研究人员能够在大规模上研究数据效应。该数据集的发布不仅为研究人员提供了更高质量和更大规模的数据,还为人工智能的发展开辟了新的可能性。

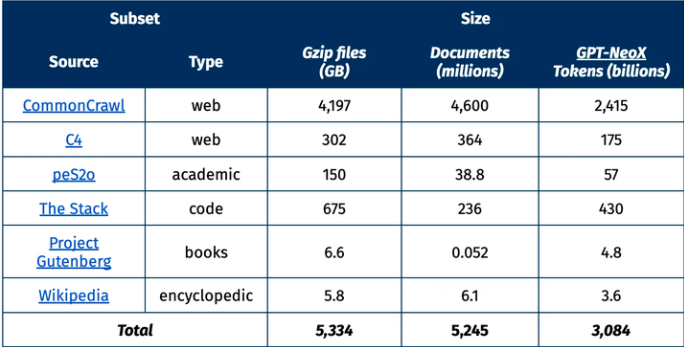

AI2Dolma 是一个开放的预训练数据集,包含3万亿个标记。它由 Allen AI 研究所创建,用于语言模型的预训练。该数据集的目标是推动大规模自然语言处理系统的研究,并提供一个透明和开放的平台。

项目地址:https://huggingface.co/datasets/allenai/dolma

Dolma 数据集包含了来自各种来源的文本,如网络内容、学术出版物、代码、书籍和百科全书资料。该数据集的设计原则包括开放性、代表性、规模和可重现性。

Dolma 的创建过程包括数据处理步骤,如语言识别、质量过滤、去重复、风险缓解等。与闭源数据集相比,Dolma 采取了更多的透明度,提供了更多的信息和工具以便其他研究者进行研究和评估。Dolma 数据集已经发布,并在 AI2ImpACT 许可下可在 HuggingFace Hub 上下载使用。

特点:

1. 数据规模庞大:AI2Dolma 是迄今为止最大的开放数据集,包含了来自多个来源的3万亿个标记。这使得它成为训练大规模语言模型的理想选择。

2. 开放性:AI2Dolma 的目标是以透明和开放的方式构建语言模型。它的数据集和模型遵循 AI2ImpACT 许可证,可以供其他研究人员使用和研究,促进了整个研究社区的合作和发展。

3. 代表性:AI2Dolma 的数据集与其他语言模型数据集(无论是闭源还是开源)具有相似的来源和处理方式,确保了模型在广泛领域的能力和行为与其他语言模型一致。

4. 可复现性:AI2Dolma 的数据处理工具和方法都是开放可用的,其他研究人员可以复现和使用这些工具来创建自己的数据集。这种可复现性有助于推动研究的进展和结果的验证。

5. 风险控制:AI2Dolma 在数据处理过程中采取了一系列风险控制措施,包括个人信息的删除、有害内容的过滤等,以最大程度地降低数据使用可能带来的风险。

6. 其他语言支持:虽然 AI2Dolma 的第一个版本仅包含英文数据,但它的设计目标是支持多种语言。未来的版本可能会扩展到其他语言,从而满足不同语言背景下的研究需求。

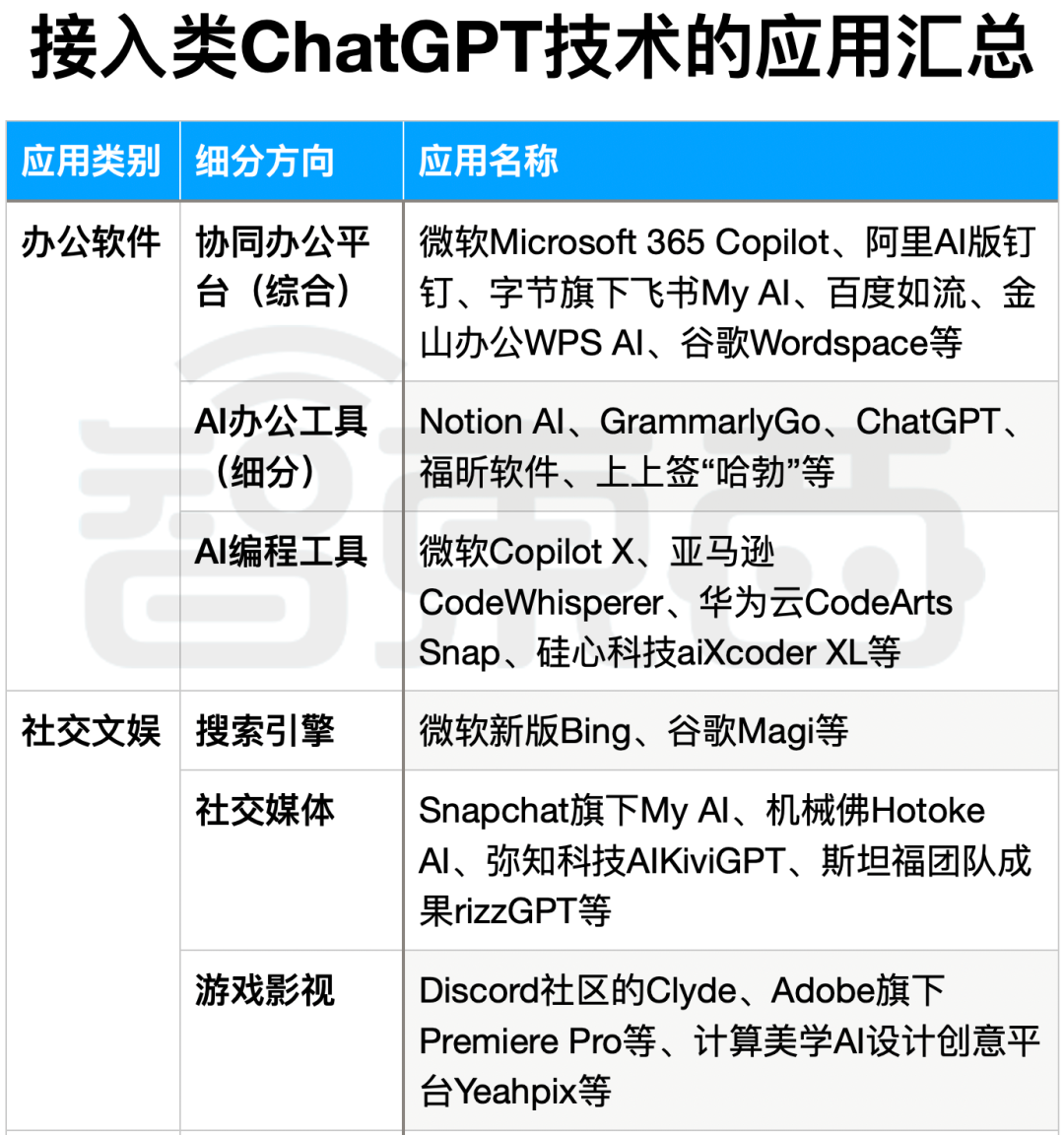

全面接入!ChatGPT杀进15个商业应用,让AI替你打工

ChatGPTAPI开放60多天,世界已经不是两个月前的样子了。微软联合创始人比尔·盖茨称GPT是“40多年来最革命性的技术进步”,英伟达创始人黄仁勋高呼:“我们正处于AI的iPhone时刻”,阿里董事会主席兼CEO张勇也说:“所有行业都值得用大模型重做一遍。”从一个风靡全球的AI玩具到独具潜力的赚钱法宝,对话机器人ChatGPT仅仅用了不到半年。站长网2023-05-10 09:20:500000体验完7款AI产品,我找到了提升工作效率的新窍门

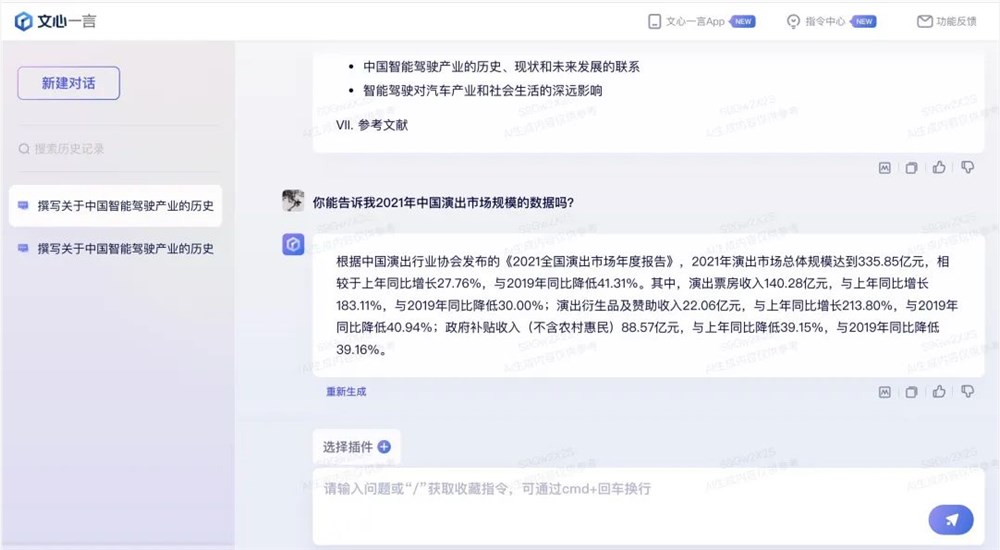

大模型的时代似乎真正到来了。伴随着8月31日凌晨百度文心一言的正式开放,首批语言大模型产品获批名单也终于出炉。它们共有11家,基本都是生成式AI,主要面向C端用户开放。也就是说,从这个秋天开始,每个人都可以直接使用到国内最前沿的AI产品,感受新科技的魅力。站长网2023-09-04 09:07:130000新一代安卓操作系统Android 14正式发布:首批支持手机品牌公布 小米等在列

快科技10月5日消息,周三谷歌在纽约举行了一年一度的MadebyGoogle2023发布会,除了Pixel8和Pixel8Pro两款手机之外,还发布了新版安卓系统Android14,以及生成式AI加持的谷歌助手AssistantwithBard。站长网2023-10-05 22:11:2700032大模型赛道正“热”:卷场景、卷芯片、卷人才

比五一假期还要火热的,只有大模型赛道了。ChatGPT、AIGC、算力、云计算、人工智能……只要与这几个关键词挂钩,就能堂而皇之均冠以“大模型”之名,资本为之侧目,股价随之而涨。据中新经纬不完全统计,截至目前中国已有超过40家公司、机构发布了大模型产品或公布了大模型计划。而在这些公司里,不乏百度、阿里巴巴、字节跳动、华为、小米等互联网大厂。站长网2023-05-11 14:21:320000巴菲特股东大会:面对 AI 没有选择 必须要去接受它、应对它、使用它

伯克希尔哈撒韦公司年度股东大会日前在奥马哈正式开幕,92岁的巴菲特及多年老搭档99岁的芒格与数万名股东,其中包括数千名中国投资人面对面交流。在近六个小时的问答环节中,回答了各界投资人48个问题,涉及宏观经济、地缘政治、银行业危机、企业经营、家族传承等方方面面。站长网2023-05-08 09:10:260000