如何识别出由AI生成的的图像?这几个办法了解下

随着人工智能图像技术的进步,辨别真实图片和AI生成图片变得越来越困难。OpenAI的DALL-E2、Stable Diffusion等工具可以生成逼真的图像,很容易误导人们。

这会带来严重后果,从政治宣传到深度伪造色情内容。为此,业界正在研究识别AI生成图像的方法,但目前还没有完美的解决方案。

下面,跟大家分享几种方法来评估图像,提高识别AI生成内容的能力:

1. 反向图像搜索,查看图片的来源是否可信。

如果相关图像具有新闻价值,请反向图像搜索以尝试确定其来源。如果一张照片在社交媒体上流传,这并不意味着它是合法的。如果你在可信度高新闻网站上找不到它,但它看起来具有开创性,那么它用AI生成的可能性就很大。

2. 放大检查图像,查看像素、轮廓等细节问题。

由于人工智能将其创作与其他人的原创作品拼凑在一起,因此它可以近距离显示一些不一致之处。当你检查图像中是否存在人工智能迹象时,请尽可能放大图像的每个部分。通过这种方式,杂散像素、奇怪的轮廓和错位的形状将更容易看到。

3. 检查人物是否过于完美,缺乏真实的皮肤纹理。

人工智能通常不能很好地处理毛孔或其他缺陷。如果事物在图像中看起来太完美而不真实,那么它们很可能不是真实的。

4. 比较不同区域,检查是否存在不一致之处。

可以仔细查看图像还可以发现不一致的地方,例如画面人物手指问题,需要注意的是:Midjourney 最近在渲染人类数字方面已经变得相当出色,因此弄清楚是否AI生成的,不仅要看手指问题,还需要查看其它细节,如光影、照明是否合理等等。

5. 检查背景是否模糊、缺少细节。

通常,人工智能会努力创建图像的前景,从而使背景变得模糊或模糊。扫描那个模糊的区域,看看是否有任何可识别的标志轮廓,但似乎不包含任何文字,或者是否有让人感觉不舒服的地形特征。

6.使用检测工具

除了用上述的方法,大家还可以使用AI工具来检测,如“是否AI”、Hive等,虽不完全可靠,但可以提供参考。

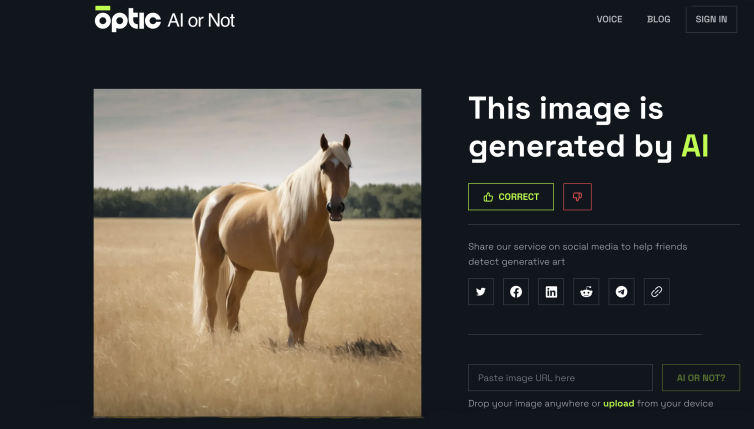

AI or Not

工具网址:https://www.aiornot.com/

您可以将可疑图像拖放到、上传或将 URL 放入AI or Not接收其检测。案例中上传了一张马的“照片”,该照片是用Stable Diffusion创建的,并得到了明确的答案:人工智能。

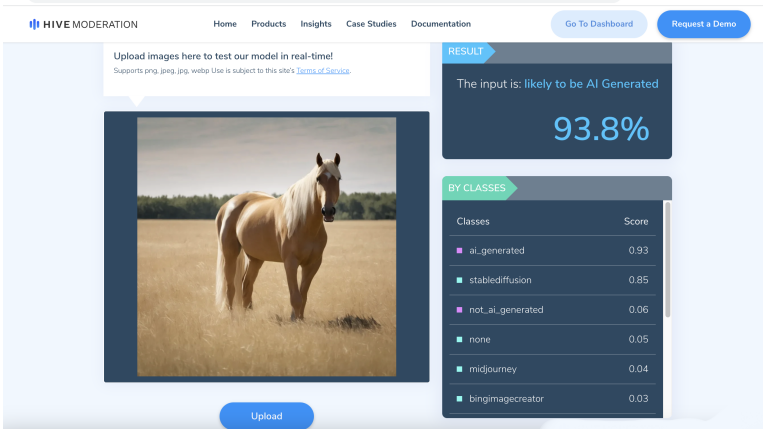

Hive AI 生成的内容检测

工具网址:https://hivemoderation.com/ai-generated-content-detection

Hive Moderation 是一家销售 AI 导向的内容审核解决方案的公司,它有一个AI 检测器,您可以在其中上传或拖放图像。案例图像的得分为93.8%,很可能是 AI 生成的。

尽管很难完全区分真实图片和AI生成内容,但这些方法值得试试,最后提醒大家不轻易相信看似真实但无法验证来源的敏感图片。

冯提莫“二次跳槽”:签约抖音游戏公会,重心还在直播吗?

与B站合约到期、停播7个月后,冯提莫要回归了。7月6日,抖音游戏公会“微应互动”发布了与冯提莫签约的消息。随后,冯提莫工作室也官宣了该消息。签约抖音公会,冯提莫这是要来抖音开播了?对此,新播场咨询了微应互动相关人士,对方称冯提莫后续动向以她的团队发声为准,并表示快了。冯提莫直播至今已经接近10年,在斗鱼、B站都曾是“一姐”的存在。站长网2023-07-14 20:07:510003马斯克为建立 xAI 从特斯拉挖来优秀工程师

划重点:-⭐️马斯克为建立xAI从特斯拉挖来优秀工程师-⭐️xAI的人才争夺战激烈,马斯克着力发展人工智能-⭐️特斯拉计算机视觉团队面临人才流失挑战,xAI在招聘AI领域专才上取得优势0000AI视野:Pika1.0正式向所有人开放;阿里开源文生3D模型;Midjourney V6涉嫌侵权;谷歌推出新AI SDK

新鲜AI产品点击了解:https://top.aibase.com/🤖📱💼AI应用Pika1.0正式向所有人开放Pika1.0官方宣布正式向所有人开放网页版本试用资格,每个用户都可免费体验该创意视频制作平台。该版本以文生成视频为特色,提供3秒视频快速生成和背景修改等功能,尤其擅长动漫风格的动物生成。虽然部分用户反映生成效果与宣传有差距,但阶段性免费使用提供机会。站长网2023-12-26 15:43:090000刚刚,一位机器人戴着毕业帽走出清华

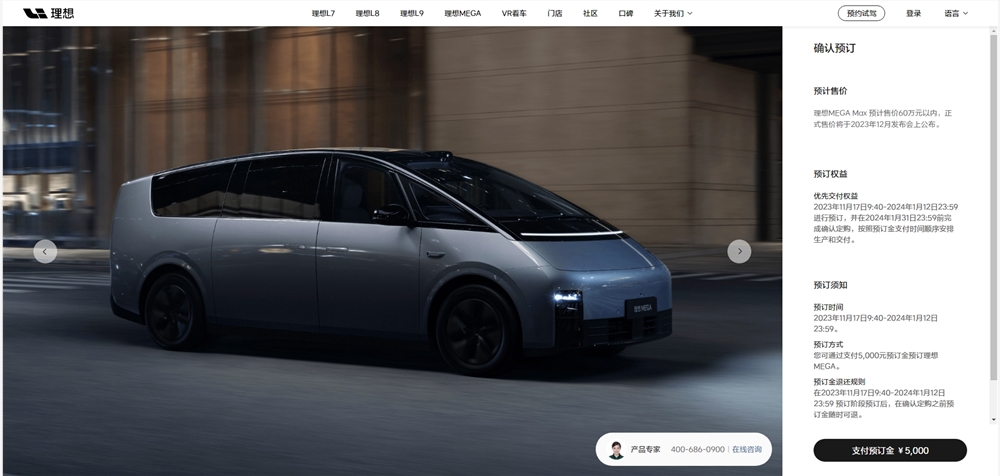

这年头,人形机器人都有清华的学士帽戴!这位走出清华二校门的机器人,简直要把门口参加暑期研习营的小孩们馋哭了。不仅拥有清华紫学士帽,在刚刚结束的WAIC“具身通用人工智能”论坛上,这个名叫小星的人形机器人,还和图灵奖得主、中国科学院院士姚期智合影贴贴。是谁羡慕了?我不说。站长网2023-07-30 21:57:510000理想MEGA开放预订 订金5000元

理想MEGA现已在官网开放预订,消费者需支付5000元预定金。该车型的正式售价将在2023年12月的发布会上公布。预订时间为2023年11月17日9:40至2024年1月12日23:59,消费者需在此期间预订。订单确认定购的截止时间是2024年1月31日23:59,按照预定金的支付时间顺序,厂商将安排生产和交付。站长网2023-11-17 10:26:030000

正在请求数据,请稍候!

正在请求数据,请稍候!