研究人员设计机器学习模型以更好地预测青少年自杀和自残风险

站长网2023-09-05 10:47:190阅

文章概要:

1. 澳大利亚青少年中自杀和自残现象十分普遍,需要更好的风险评估方法。

2. 研究人员使用机器学习模型分析了多种潜在风险因素,发现情绪问题、学校家庭环境等都是重要预测因素。

3. 相比仅考虑过去尝试史,这些模型可以更准确预测未来自杀自残风险。

新南威尔士大学的最新研究显示,人工智能可以帮助识别青少年自杀和自伤的风险因素。

研究人员使用澳大利亚一项纵向追踪调查的参与者数据,这些14-17岁青少年中有10.5%报告有自伤行为,5.2%报告最近一年至少一次自杀尝试。

研究收集了超过4000个潜在风险因素数据,然后使用机器学习模型分析哪些因素最能预测未来的自杀自伤行为。

图源备注:图片由AI生成,图片授权服务商Midjourney

结果显示,抑郁、焦虑、行为问题、自我认知及环境压力是最重要的风险预测因素。另外,之前的自杀企图反而不是主要的预测因子。这与当前仅依据历史尝试评估风险的做法不同。研究还发现,学校和家庭环境对青少年心理健康的影响可能大于先前的认知。

研究人员根据确定的最重要的风险因素创建了机器学习模型,以预测研究参与者的自杀和自残行为,这些模型能够比标准方法更准确地预测尝试。

研究人员认为,这样的机器学习模型可以辅助临床评估青少年的自杀自伤风险。但是还需要在实际患者数据上验证模型的准确性。

研究人员表示,像这样的机器学习模型可以支持临床医生评估青少年患者的自杀和自残风险。“根据患者信息,机器学习算法可以计算每个人的分数,并且可以将其集成到电子病历系统中。临床医生可以快速检索该信息以确认或调整他们的评估。”

利用大数据和人工智能可以更准确预测青少年的自杀自伤风险,以便及早干预。但是模型也需要考虑诸多社会和环境因素,而不仅仅依赖个体心理状况。

0000

评论列表

共(0)条相关推荐

谷歌第二季度营收达746亿美元 人工智能成为财报会议主题

谷歌的母公司Alphabet周二收盘后公布了超出预期的第二季度财务业绩。在搜索、广告和移动软件方面长期无可争议的主导地位之后,随着公司面临来自竞争对手的激烈竞争,尤其是微软,后者与OpenAI建立了人工智能联盟,Alphabet的盈利已经成为科技行业的一个备受期待的风向标。Alphabet首席执行官SundarPichai表示:“我们的产品和公司都有令人兴奋的动力,推动了本季度的强劲业绩。”站长网2023-07-26 10:52:180000iPhone16Pro四款配色曝光 包括古铜色、纯净原色等

近期,海外爆料者披露了iPhone16ProMax的机模信息,揭示了苹果即将推出的旗舰手机将采用的四款全新配色方案。据曝光,iPhone16Pro系列将提供四种颜色选择:经典白色、深邃黑色、纯净原色以及引人注目的全新古铜色。这款古铜色是苹果首次尝试,它取代了iPhone15Pro系列中反响平平的蓝色版本。古铜色的灵感来源于iPhone5s/6系列的香槟金,但呈现出更为深沉的色调。站长网2024-08-19 09:42:300000AI视野:谷歌推多模态大模型Gemini;抖音上线抖音心晴;苹果发布 MLX 模型框架;Meta推出AI图像生成器网站

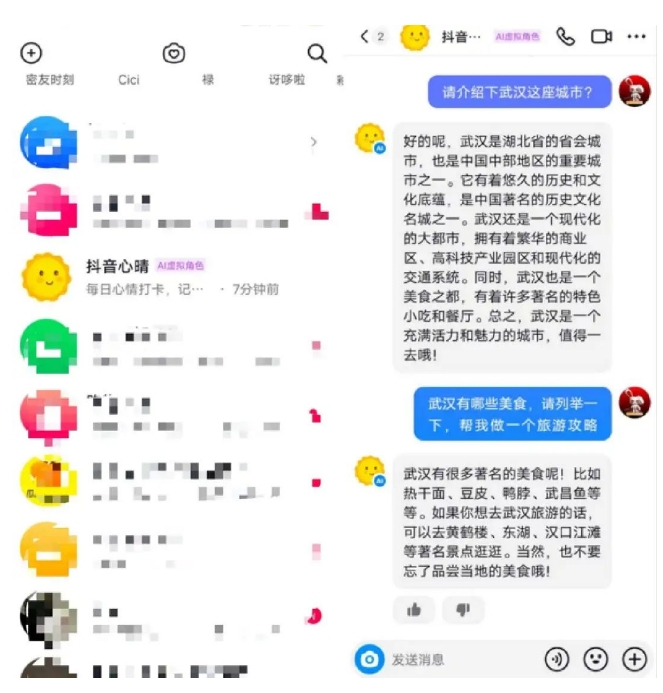

🤖📈💻💡大模型动态谷歌发布Gemini谷歌推出多模态大模型Gemini1.0,具备处理文本、代码、音频、图像和视频等多种信息的能力,分为Ultra、Pro和Nano三种规模,性能超越领先模型,GeminiUltra在多任务语言理解中首次超越人类专家水平,计划明年初向开发者推出。【AiBase提要】站长网2023-12-07 16:07:490000网易版小红书!“网易小蜜蜂”App悄然上线:发力种草生意

网易推出"小蜜蜂"内容社区App,主打年轻人日常分享近日,网易上线了一款名为"小蜜蜂"的应用,是一款针对年轻人的内容社区平台。用户可在平台分享日常生活,与他人交流互动。目前,用户仅可使用手机号登录,并需在注册时选择就业状态(在校或职场)。用户也可上传工卡验证身份。从界面和外观上看,网易小蜜蜂与小红书App有相似之处,似乎借鉴了小红书的内容社区模式。0001安卓最强U!联发科天玑9300 宣布5月7日发布

快科技4月29日消息,联发科天玑开发者大会MDDC2024将于5月7日举行,天玑9300旗舰芯片将在大会上发布。据爆料,vivoX100S将首发这颗芯片,RedmiK70至尊版紧随其后,加入首批搭载行列。天玑9300基于台积电4nm工艺打造,架构延续了4颗超大核4颗大核组合。CPU主频最高为3.4GHz,Geekbench6单核成绩2300,多核成绩7700。站长网2024-04-30 07:41:000002